يهدف هذا البحث إلى استكشاف مجالات الذكاء الاصطناعي الأكثر أهمية للمطورين، والتي قد تكون الفرص التالية للانفجار في مجال Web3 والذكاء الاصطناعي.

قبل مشاركة رؤى بحثية جديدة، أولاً وقبل كل شيء، يسعدنا المشاركة في الجولة الأولى منRedPill بإجمالي 5 ملايين دولار أنا أيضًا متحمس جدًا بشأن التمويل وأتطلع إلى النمو معًا معRedPill!

TL;DR

نظرًا لأن الجمع بين Web3 والذكاء الاصطناعي أصبح موضوعًا ساخنًا في عالم العملات المشفرة، فإن أساس الذكاء الاصطناعي في عالم العملات المشفرة، يزدهر إنشاء المرافق، ولكن لا يوجد العديد من التطبيقات التي تستخدم الذكاء الاصطناعي فعليًا أو مصممة للذكاء الاصطناعي، كما تظهر مشكلة تجانس البنية التحتية للذكاء الاصطناعي تدريجيًا. لقد أثارت مشاركتنا الأخيرة في الجولة الأولى من تمويل RedPill بعض الفهم الأعمق.

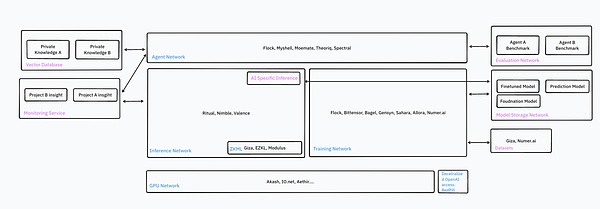

تتضمن الأدوات الرئيسية لإنشاء AI Dapp الوصول اللامركزي إلى OpenAI وشبكة GPU وشبكة الاستدلال. وشبكات الوكلاء.

السبب وراء شهرة شبكة GPU أكثر من "فترة تعدين البيتكوين" هو أن: سوق الذكاء الاصطناعي أكبر والنمو سريع وثابت؛ ويدعم الذكاء الاصطناعي ملايين التطبيقات كل يوم؛ ويتطلب الذكاء الاصطناعي مجموعة متنوعة من نماذج وحدات معالجة الرسومات ومواقع الخوادم؛ وأصبحت التكنولوجيا أكثر نضجًا مما كانت عليه في الماضي، وهي تستهدف قاعدة عملاء أوسع.

تمتلك شبكات الاستدلال وشبكات الوكلاء بنية تحتية متشابهة، ولكن لها تركيزات مختلفة. إن شبكات الاستدلال مخصصة في المقام الأول للمطورين ذوي الخبرة لنشر نماذجهم الخاصة، ولا يتطلب تشغيل النماذج غير LLM بالضرورة وحدة معالجة الرسومات. تركز شبكة الوكلاء بشكل أكبر على LLM ولا يحتاج المطورون إلى إحضار نماذجهم الخاصة، ولكنهم يركزون أكثر على الهندسة السريعة وكيفية ربط الوكلاء المختلفين. تتطلب شبكات الوكيل دائمًا وحدات معالجة رسومات عالية الأداء.

تحمل مشاريع البنية التحتية للذكاء الاصطناعي وعودًا كبيرة ولا تزال تطرح ميزات جديدة.

لا تزال معظم مشاريع التشفير الأصلية في مرحلة اختبار الشبكة، مع ضعف الاستقرار والتكوين المعقد والوظائف المحدودة الوقت لإثبات فعاليتها الأمن والخصوصية.

بافتراض أن AI Dapp أصبح اتجاهًا كبيرًا، لا يزال هناك العديد من المجالات غير المستكشفة، مثل المراقبة والبنية التحتية ذات الصلة بـ RAG وWeb3 النماذج الأصلية، والوكلاء اللامركزيون مع واجهات برمجة التطبيقات والبيانات الأصلية المشفرة والمدمجة، وشبكات التقييم، والمزيد.

يعد التكامل الرأسي اتجاهًا مهمًا. يحاول مشروع البنية التحتية توفير خدمة شاملة لتبسيط عمل مطوري AI Dapp.

سيكون المستقبل مختلطًا. يتم إجراء جزء من الاستدلال على الواجهة الأمامية ويتم حساب الجزء الآخر على السلسلة، مما يسمح باعتبارات التكلفة وإمكانية التحقق.

المصدر: IOSG

مقدمة

الجمع بين Web3 وAI هو الاتجاه الحالي مجال التشفير من أكثر المواضيع التي يتم الحديث عنها. يقوم المطورون الموهوبون ببناء بنية تحتية للذكاء الاصطناعي لعالم العملات المشفرة، ويعملون على جلب الذكاء إلى العقود الذكية. يعد إنشاء تطبيق AI dApp مهمة معقدة للغاية، حيث يتعامل المطورون مع البيانات والنماذج وقوة الحوسبة والعمليات والنشر والتكامل مع blockchain. استجابة لهذه الاحتياجات، قام مؤسسو Web3 بتطوير العديد من الحلول الأولية، مثل شبكات GPU، والتعليقات التوضيحية لبيانات المجتمع، والنماذج المدربة من قبل المجتمع، واستدلال الذكاء الاصطناعي والتدريب الذي يمكن التحقق منه، ومخازن الوكلاء.

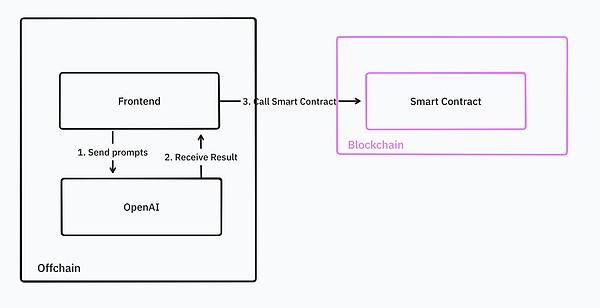

على خلفية هذه البنية التحتية المزدهرة، لا توجد العديد من التطبيقات التي تستفيد بالفعل من الذكاء الاصطناعي أو مصممة للذكاء الاصطناعي. عندما يبحث المطورون عن دروس تطوير AI dApp، يجدون أنه لا يوجد الكثير من البرامج التعليمية المتعلقة بالبنية الأساسية للتشفير الأصلي للذكاء الاصطناعي. تتضمن معظم البرامج التعليمية فقط استدعاء OpenAI API على الواجهة الأمامية.

المصدر: IOSG Ventures

فشل التطبيق الحالي في الاستفادة الكاملة من تتميز الكتلة باللامركزية والقابلة للتحقق للسلسلة، لكن هذا سيتغير قريبًا. الآن، أطلقت معظم البنى التحتية للذكاء الاصطناعي التي تركز على العملات المشفرة شبكات اختبار وتخطط لتشغيلها رسميًا خلال الأشهر الستة المقبلة.

ستشرح هذه الدراسة بالتفصيل الأدوات الرئيسية المتاحة في البنية التحتية للذكاء الاصطناعي في مجال العملات المشفرة. دعونا نستعد للحظة GPT-3.5 في عالم العملات المشفرة!

1. RedPill: توفير ترخيص لا مركزي لـ OpenAI

كما ذكرنا أعلاه، استثمارنا في RedPill نقطة مقدمة جيدة.

يحتوي OpenAI على العديد من النماذج القوية ذات المستوى العالمي، مثل GPT-4-vision وGPT-4-turbo وGPT-4o، والتي تعتبر مثالية للبناء المتقدم تطبيقات الذكاء الاصطناعي المفضلة.

يمكن للمطورين الاتصال بـ OpenAI API من خلال واجهة Oracle أو الواجهة الأمامية لدمجها في dApps.

يدمج RedPill واجهات برمجة تطبيقات OpenAI من مطورين مختلفين ضمن واجهة واحدة لتزويد المستخدمين في جميع أنحاء العالم بخدمات ذكاء اصطناعي سريعة واقتصادية ويمكن التحقق منها، وبالتالي تحقيق ديمقراطية نموذج الذكاء الاصطناعي الأعلى موارد. تقوم خوارزمية التوجيه الخاصة بـ RedPill بتوجيه طلبات المطورين إلى مساهم واحد. سيتم تنفيذ طلبات واجهة برمجة التطبيقات (API) من خلال شبكة التوزيع الخاصة بها، وبالتالي تجاوز أي قيود محتملة من OpenAI، وحل بعض المشكلات الشائعة التي يواجهها مطورو العملات المشفرة، مثل:

باستخدام نفس رمز الطلب مع تغيير اسم المضيف، يمكن للمطورين تحقيق تكلفة منخفضة وقابلية تطوير عالية وطريقة غير محدودة للوصول نماذج OpenAI.

2. شبكة GPU

بالإضافة إلى استخدام واجهة برمجة تطبيقات OpenAI، يختار العديد من المطورين استضافة نماذجهم الخاصة في المنزل. يمكنهم الاعتماد على شبكات GPU اللامركزية، مثل io.net وAethir وAkash وغيرها من الشبكات الشائعة، لبناء مجموعات GPU الخاصة بهم ونشر وتشغيل العديد من النماذج القوية الداخلية أو مفتوحة المصدر.

يمكن لشبكة GPU اللامركزية هذه الاستفادة من قوة الحوسبة للأفراد أو مراكز البيانات الصغيرة لتوفير تكوينات مرنة والمزيد من خيارات موقع الخادم وتكاليف أقل للمطورين إجراء التجارب المتعلقة بالذكاء الاصطناعي بسهولة ضمن ميزانية محدودة. ومع ذلك، نظرًا لطبيعتها اللامركزية، فإن شبكات GPU هذه لها قيود معينة من حيث الوظائف وسهولة الاستخدام وخصوصية البيانات.

ازدهر الطلب على وحدة معالجة الرسومات خلال الأشهر القليلة الماضية، متجاوزًا طفرة تعدين البيتكوين السابقة. ومن أسباب هذه الظاهرة ما يلي:

تزايد عدد العملاء المستهدفين، وشبكة GPU يخدم الآن مطوري الذكاء الاصطناعي، وأعدادهم ليست كبيرة فحسب، بل أيضًا أكثر ولاءً ولن تتأثر بتقلبات أسعار العملات المشفرة.

مقارنة بالمعدات الخاصة بالتعدين، توفر وحدات معالجة الرسوميات اللامركزية المزيد من النماذج والمواصفات، ويمكنها تلبية متطلبات iez بشكل أفضل. على وجه الخصوص، تتطلب معالجة النماذج الكبيرة VRAM أعلى، بينما تتمتع المهام الأصغر بخيارات GPU أكثر ملاءمة. وفي الوقت نفسه، يمكن لوحدات معالجة الرسومات اللامركزية أن تخدم المستخدمين النهائيين من مسافة قريبة وتقلل من زمن الوصول.

أصبحت التكنولوجيا ناضجة بشكل متزايد، وتعتمد شبكات GPU على سلاسل الكتل عالية السرعة مثل تسوية Solana، وتقنية Docker الافتراضية، وRay مجموعات الحوسبة.

فيما يتعلق بالعائد على الاستثمار، يتوسع سوق الذكاء الاصطناعي وهناك العديد من الفرص لتطوير تطبيقات ونماذج جديدة. العائد المتوقع على نموذج H100 هو 60-70%، في حين أن تعدين البيتكوين أكثر تعقيدًا، والفائز يأخذ كل شيء، والإنتاج محدود.

كما بدأت شركات تعدين البيتكوين مثل Iris Energy وCore Scientific وBitdeer في دعم شبكات GPU، وتوفير خدمات الذكاء الاصطناعي، والعمل بنشاط شراء وحدات معالجة الرسومات المصممة خصيصًا للذكاء الاصطناعي، مثل H100.

التوصية: لمطوري Web2 الذين لا يهتمون كثيرًا باتفاقية مستوى الخدمة، io.net يوفر تجربة بسيطة وسهلة الاستخدام، واختيارًا فعالاً من حيث التكلفة.

3. شبكة الاستدلال

هذا هو جوهر البنية التحتية للذكاء الاصطناعي الأصلي المشفر. وسوف تدعم المليارات من عمليات الاستدلال AI في المستقبل. توفر العديد من طبقات الذكاء الاصطناعي 1 أو الطبقة 2 للمطورين القدرة على استدعاء استنتاج الذكاء الاصطناعي محليًا على السلسلة. ومن بين الشركات الرائدة في السوق Ritual وValence وFetch.ai.

تختلف هذه الشبكات في النواحي التالية:

الأداء (زمن الوصول، وقت الحساب)

النماذج المدعومة

قابلية التحقق

السعر (تكلفة الاستهلاك على السلسلة، تكلفة الاستدلال)

تجربة التطوير

3.1 الأهداف

من الناحية المثالية، يمكن للمطورين الوصول إليها بسهولة من أي مكان، من خلال أي شكل من أشكال الإثبات. خدمات استدلال الذكاء الاصطناعي المخصصة، هناك تقريبًا عدم وجود عوائق في عملية التكامل.

توفر شبكة الاستدلال كل الدعم الأساسي المطلوب من قبل المطورين، بما في ذلك إنشاء البراهين والتحقق منها عند الطلب، وحسابات الاستدلال، وترحيل بيانات الاستدلال والتحقق منها، وتوفر واجهات Web2 وWeb3، ونشر النموذج بنقرة واحدة، ومراقبة النظام، والعمليات عبر السلسلة، والتكامل المتزامن ووظائف التنفيذ المجدولة.

المصدر: IOSG Ventures

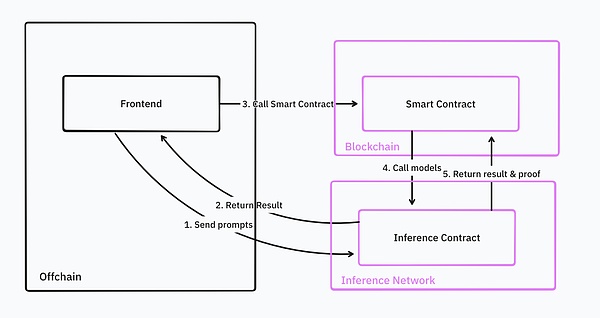

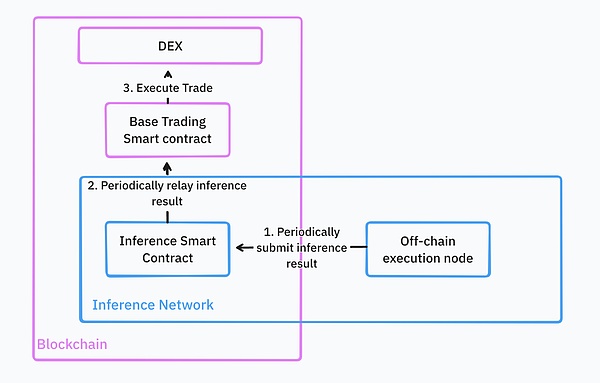

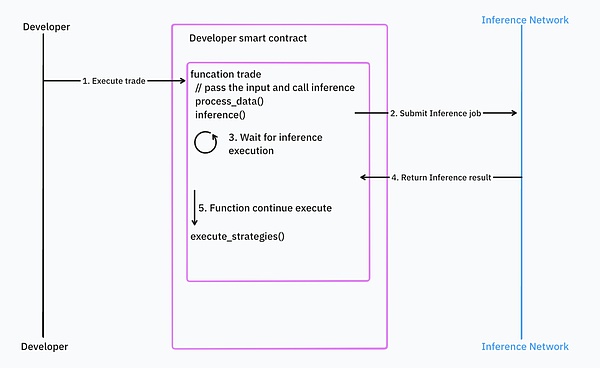

باستخدام هذه الإمكانات، يمكن للمطورين دمج خدمات الاستدلال بسلاسة في عقودهم الذكية الحالية. على سبيل المثال، عند إنشاء روبوتات تداول DeFi، ستستخدم هذه الروبوتات نماذج التعلم الآلي للعثور على فرص الشراء والبيع لأزواج تداول محددة وتنفيذ استراتيجيات التداول المقابلة على منصة التداول الأساسية.

في عالم مثالي تمامًا، ستكون جميع البنية التحتية مستضافة على السحابة. يقوم المطورون ببساطة بتحميل نماذج إستراتيجية التداول الخاصة بهم بتنسيق شائع مثل الشعلة، وتقوم شبكة الاستدلال بتخزين النموذج واستعلامات Web2 وWeb3.

بعد اكتمال جميع خطوات نشر النموذج، يمكن للمطورين استدعاء استنتاج النموذج مباشرة من خلال Web3 API أو العقود الذكية. ستقوم شبكة الاستدلال بتنفيذ استراتيجيات التداول هذه بشكل مستمر وتغذية النتائج إلى العقد الذكي الأساسي. إذا كان المطور يدير مبلغًا كبيرًا من أموال المجتمع، فمن الضروري أيضًا تقديم التحقق من نتائج الاستدلال. بمجرد تلقي نتائج الاستدلال، يقوم العقد الذكي بإجراء المعاملات بناءً على هذه النتائج.

المصدر: IOSG Ventures

3.1.1 غير متزامن مقابل متزامن

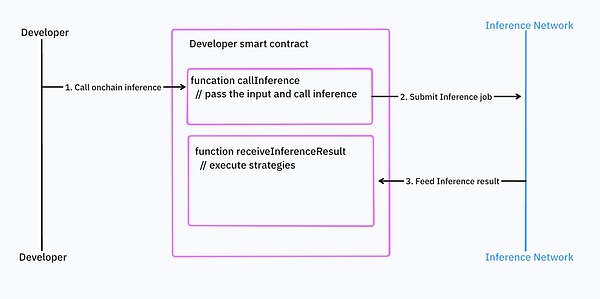

< p style="text-align: left;">من الناحية النظرية، يمكن أن تؤدي عمليات الاستدلال المنفذة بشكل غير متزامن إلى أداء أفضل، ومع ذلك، قد يكون هذا الأسلوب غير مناسب في تجربة التطوير.

عند استخدام الطريقة غير المتزامنة، يحتاج المطورون إلى إرسال المهمة إلى العقد الذكي لشبكة الاستدلال أولاً. عند اكتمال مهمة الاستدلال، سيعيد العقد الذكي لشبكة الاستدلال النتائج. في نموذج البرمجة هذا، ينقسم المنطق إلى قسمين: استدعاء الاستدلال ومعالجة نتائج الاستدلال.

المصدر: IOSG Ventures

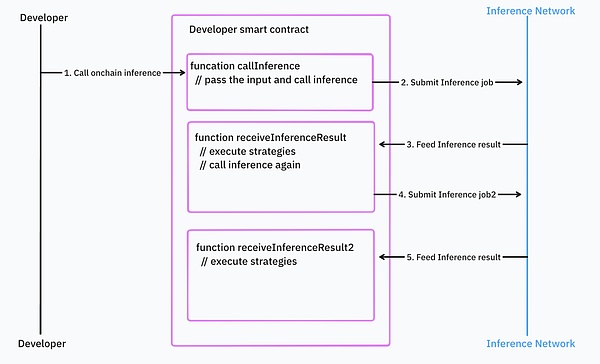

يزداد الوضع سوءًا إذا قام المطور بتداخل مكالمات الاستدلال والكثير من منطق التحكم.

المصدر: IOSG Ventures

نموذج البرمجة غير المتزامن يجعل من الصعب التكامل مع العقود الذكية الحالية. يتطلب هذا من المطورين كتابة الكثير من التعليمات البرمجية الإضافية ومعالجة الأخطاء وإدارة التبعيات.

نسبيًا، تعد البرمجة المتزامنة أكثر سهولة بالنسبة للمطورين، ولكنها تسبب مشاكل في وقت الاستجابة وتصميم blockchain. على سبيل المثال، إذا كانت بيانات الإدخال تغير البيانات بسرعة مثل وقت الكتلة أو السعر، فإن البيانات لم تعد جديدة بعد اكتمال الاستدلال، مما قد يتسبب في التراجع عن تنفيذ العقد الذكي في ظل ظروف معينة. تخيل أنك تقوم بالتداول بسعر قديم.

المصدر: IOSG Ventures

تستخدم معظم البنية التحتية للذكاء الاصطناعي معالجة غير متزامنة، لكن Valence يحاول حل هذه المشكلات.

3.2 الواقع

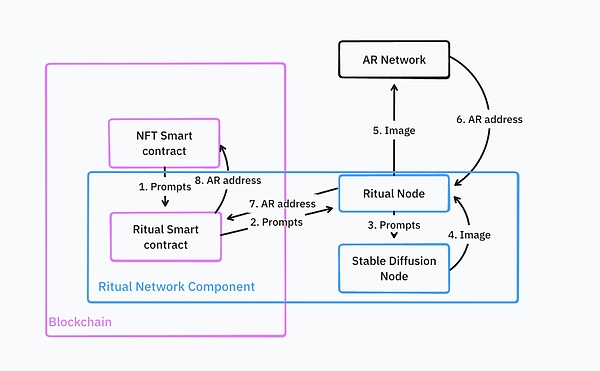

في الواقع، كثيرون لا تزال شبكات الاستدلال الجديدة في مرحلة الاختبار، مثل شبكة Ritual. وفقًا لوثائقها العامة، تتمتع هذه الشبكات حاليًا بوظائف محدودة (وظائف مثل التحقق والتصديق ليست متاحة بعد على الإنترنت). وهي لا توفر حاليًا بنية تحتية سحابية لدعم حسابات الذكاء الاصطناعي على السلسلة، ولكنها توفر بدلاً من ذلك إطار عمل لحسابات الذكاء الاصطناعي ذاتية الاستضافة وتمرير النتائج على السلسلة.

هذه بنية لتشغيل AIGC NFTs. يقوم نموذج الانتشار بإنشاء NFTs وتحميلها إلى Arweave. ستستخدم شبكة الاستدلال عنوان Arweave هذا لسك NFT على السلسلة.

المصدر: IOSG Ventures

هذه العملية معقدة للغاية، ويحتاج المطورون إلى نشر وصيانة معظم البنية التحتية بأنفسهم، مثل الخدمة المخصصة العقد الطقوسية المنطقية وعقد الانتشار المستقر والعقود الذكية لـ NFT.

التوصية:تعد شبكات الاستدلال الحالية معقدة للغاية في دمج النماذج المخصصة ونشرها، وفي هذه المرحلة لا تزال معظم الشبكات تعمل بوظيفة المصادقة غير معتمد. إن تطبيق تقنية الذكاء الاصطناعي على الواجهة الأمامية سيوفر للمطورين خيارًا بسيطًا نسبيًا. إذا كنت بحاجة حقًا إلى وظيفة التحقق من الصحة، فإن مزود ZKML في الجيزة يعد خيارًا جيدًا.

4. شبكة الوكلاء

تتيح شبكة الوكلاء للمستخدمين إمكانية تخصيص الوكلاء بسهولة. تتكون هذه الشبكة من كيانات أو عقود ذكية يمكنها أداء المهام بشكل مستقل، والتواصل مع بعضها البعض، والتفاعل مع شبكة البلوكشين، كل ذلك دون تدخل بشري مباشر. ويستهدف بشكل رئيسي تكنولوجيا LLM. على سبيل المثال، يمكنه تزويد برنامج الدردشة GPT بمعرفة متعمقة عن Ethereum. الأدوات الحالية لهذا النوع من روبوتات الدردشة محدودة نسبيًا، ولا يستطيع المطورون بعد تطوير تطبيقات معقدة على هذا الأساس.

المصدر: IOSG Ventures

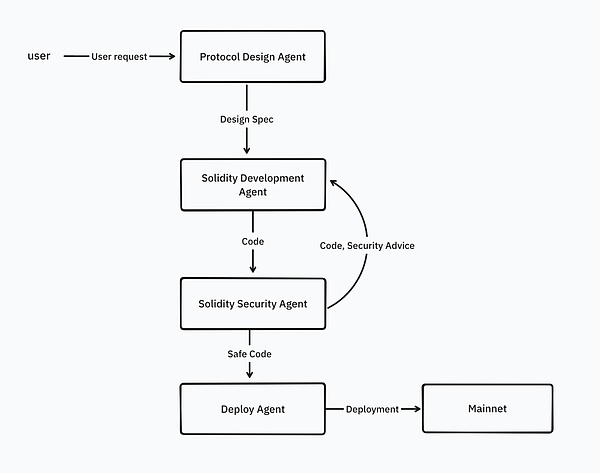

ولكن في المستقبل، ستوفر شبكة الوكلاء المزيد من الأدوات ليستخدمها الوكلاء، ليس فقط المعرفة، ولكن أيضًا يستدعي واجهات برمجة التطبيقات الخارجية، والقدرة على أداء مهام محددة، وما إلى ذلك. سيتمكن المطورون من ربط العديد من الوكلاء معًا لإنشاء مهام سير العمل. على سبيل المثال، تتضمن كتابة عقد ذكي من Solidity عدة وكلاء متخصصين، بما في ذلك وكيل تصميم البروتوكول، ووكيل تطوير Solidity، ووكيل مراجعة أمان التعليمات البرمجية، ووكيل نشر Solidity.

المصدر: IOSG Ventures

نقوم بتنسيق تعاون هؤلاء الوكلاء من خلال استخدام المطالبات والسيناريوهات.

تتضمن بعض الأمثلة على شبكات الوكيل Flock.ai، وMyshell، وTheoriq.

موصى به: يتمتع معظم الوكلاء اليوم بوظائف محدودة نسبيًا. بالنسبة لحالات استخدام معينة، يتم تقديم خدمة بروكسيات Web2 بشكل أفضل ولديها أدوات تنسيق ناضجة مثل Langchain وLlamindex.

5. الفرق بين شبكة الوكلاء وشبكة الاستدلال

تركز شبكة الوكلاء بشكل أكبر على LLM وتوفر خدمات مثل أدوات Langchain لدمج وكلاء متعددين. عادةً، لا يحتاج المطورون إلى تطوير نماذج التعلم الآلي بأنفسهم، وقد قامت شبكة الوكلاء بتبسيط عملية تطوير النموذج ونشره. إنهم فقط بحاجة إلى ربط العوامل والأدوات اللازمة. في معظم الحالات، سيستخدم المستخدمون النهائيون هذه الوكلاء مباشرة.

شبكة الاستدلال هي دعم البنية التحتية لشبكة الوكيل. يوفر للمطورين حقوق الوصول ذات المستوى الأدنى. في ظل الظروف العادية، لا يستخدم المستخدمون النهائيون شبكة الاستدلال مباشرة. يحتاج المطورون إلى نشر نماذجهم الخاصة، والتي لا تقتصر على LLM، ويمكنهم استخدامها من خلال نقاط الوصول خارج السلسلة أو على السلسلة.

شبكة الوكلاء وشبكة الاستدلال ليست منتجات مستقلة تمامًا. لقد بدأنا بالفعل في رؤية بعض المنتجات المتكاملة رأسياً. إنها توفر إمكانات الوكيل والاستدلال لأن كلتا الوظيفتين تعتمدان على بنية تحتية مماثلة.

6. فرص جديدة地< /strong>

بالإضافة إلى الاستدلال النموذجي والتدريب وشبكات الوكلاء، هناك العديد من المجالات الجديدة التي تستحق الاستكشاف في مجال web3:

مجموعة البيانات: كيفية تحويل بيانات blockchain إلى مجموعة بيانات قابلة للاستخدام للتعلم الآلي؟ ما يحتاجه مطورو التعلم الآلي هو بيانات أكثر تحديدًا وموضوعية. على سبيل المثال، توفر جيزة بعض مجموعات البيانات عالية الجودة المتعلقة بـ DeFi خصيصًا للتدريب على التعلم الآلي. يجب أن تتجاوز البيانات المثالية البيانات الجدولية البسيطة وأن تتضمن بيانات رسومية يمكنها وصف التفاعلات في عالم blockchain. وفي الوقت الحاضر، ما زلنا غير كافيين في هذا الصدد. توجد حاليًا مشاريع تعالج هذه المشكلة من خلال مكافأة الأفراد على إنشاء مجموعات بيانات جديدة، مثل Bagel و Sahara، والتي تعد بحماية خصوصية البيانات الشخصية.

تخزين النماذج: بعض النماذج كبيرة الحجم، وكيفية ذلك تخزينها وتوزيعها، ويعد التحكم في إصدار هذه النماذج أمرًا أساسيًا، وهو ما يرتبط بأداء وتكلفة التعلم الآلي على السلسلة. وفي هذا المجال، حققت المشاريع الرائدة مثل Filecoin وAR و0g تقدمًا.

نموذج التدريب: يمثل التدريب النموذجي الموزع والقابل للتحقق مشكلة. لقد أحرز كل من Gensyn وBittensor وFlock وAllora تقدمًا كبيرًا.

المراقبة: بما أن التفكير النموذجي يتم تنفيذه داخل وخارج النظام إذا حدث شيء ما، فنحن بحاجة إلى بنية تحتية جديدة لمساعدة مطوري web3 على تتبع استخدام النموذج واكتشاف المشكلات والانحرافات المحتملة في الوقت المناسب. باستخدام أدوات المراقبة المناسبة، يمكن لمطوري التعلم الآلي لـ web3 إجراء تعديلات في الوقت المناسب وتحسين دقة النموذج بشكل مستمر.

البنية التحتية لـ RAG: تتطلب RAG الموزعة بيئة بنية تحتية جديدة تمامًا، والتي لديها متطلبات أعلى للتخزين والحوسبة المدمجة وقواعد البيانات المتجهة، مع ضمان خصوصية البيانات وأمانها. وهذا يختلف تمامًا عن البنية التحتية الحالية لـ Web3 AI، والتي تعتمد في الغالب على أطراف ثالثة لإكمال RAG، مثل Firstbatch وBagel.

النماذج المخصصة لـ Web3: ليست كل النماذج مناسبة لـ Web3 سيناريوهات. في معظم الحالات، يحتاج النموذج إلى إعادة تدريبه للتكيف مع تطبيقات محددة مثل التنبؤ بالأسعار والتوصية. مع ازدهار البنية التحتية للذكاء الاصطناعي، نتوقع المزيد من نماذج web3 الأصلية لخدمة تطبيقات الذكاء الاصطناعي في المستقبل. على سبيل المثال، تقوم Pond بتطوير blockchain GNN لسيناريوهات مختلفة مثل التنبؤ بالأسعار والتوصيات واكتشاف الاحتيال ومكافحة غسيل الأموال.

تقييم الشبكات: تقييم الوكلاء في غياب التعليقات البشرية. ليس سهلا. مع ازدياد شعبية أدوات إنشاء الوكلاء، سيظهر عدد لا يحصى من الوكلاء في السوق. ويتطلب ذلك نظامًا يوضح قدرات هؤلاء الوكلاء ويساعد المستخدمين على تحديد الوكيل الذي يحقق أفضل أداء في موقف معين. على سبيل المثال، تلعب شركة Neuronets دورًا في هذا المجال.

آلية الإجماع: بالنسبة لمهام الذكاء الاصطناعي، فإن إثبات الحصة (PoS) ليس بالضرورة هو الحل أفضل خيار. يعد التعقيد الحسابي، وصعوبة التحقق، والافتقار إلى اليقين من التحديات الرئيسية التي تواجه إثبات الحصة (PoS). تقوم Bittensor بإنشاء آلية إجماع ذكية جديدة تكافئ العقد في الشبكة التي تساهم في نماذج ومخرجات التعلم الآلي.

7. التوقعات المستقبلية

نلاحظ حاليًا اتجاه تطور العمودي اندماج . من خلال بناء طبقة حوسبة أساسية، يمكن للشبكة تقديم الدعم لمجموعة متنوعة من مهام التعلم الآلي، بما في ذلك التدريب والاستدلال وخدمات شبكة الوكيل. يهدف هذا النموذج إلى توفير حل شامل وشامل لمطوري التعلم الآلي Web3.

في الوقت الحالي، يوفر الاستدلال على السلسلة، على الرغم من كونه مكلفًا وبطيئًا، إمكانية تحقق وتكاملًا ممتازين مع الأنظمة الخلفية مثل التكامل السلس. أعتقد أن المستقبل سيكون عبارة عن تطبيقات هجينة. سيتم تنفيذ جزء من معالجة الاستدلال على الواجهة الأمامية أو خارج السلسلة، في حين سيتم إكمال تلك الاستدلالات الحاسمة لاتخاذ القرار على السلسلة. هذا النموذج مستخدم بالفعل على الأجهزة المحمولة. من خلال الاستفادة من طبيعة الأجهزة المحمولة، فهي قادرة على تشغيل النماذج الصغيرة محليًا بسرعة ونقل المهام الأكثر تعقيدًا إلى السحابة للاستفادة من معالجة LLM الأكبر.

Alex

Alex

Alex

Alex Brian

Brian Weiliang

Weiliang Miyuki

Miyuki Brian

Brian Weiliang

Weiliang Joy

Joy Alex

Alex Joy

Joy Joy

Joy