イーサリアムの創設者であるヴィタリック・ブテリンが自律エージェントとDAOについて考え始めたのは2014年のことでした。

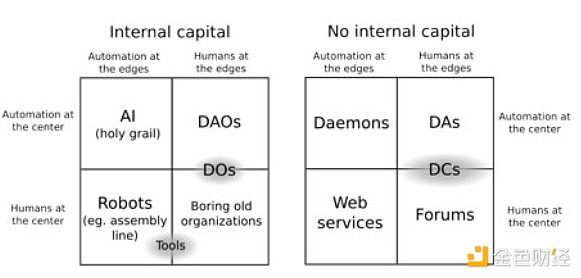

彼の初期のビジョンでは、彼の記事「DAO, DAC, DA, etc.: An Incomplete Guide to the Terminology」で説明されているように、DAOs are decentralised entities, with "Automation at the centre and humans at the edge" (DAOsは分散化された実体であり、「中心に自動化、端に人間」がいる)-に依存する組織です。効率性と透明性を維持するために、人間ではなくコードの階層に依存する組織である。

それから10年後、Variantのジェシー・ウォルデン(Jesse Walden)氏は「DAO 2.0」を出版し、DAOがVitalik氏の以前の仕事から実際にどのように進化してきたかを振り返っています。ヴィタリックの初期の仕事以来、DAOが実際にどのように進化してきたかを振り返っている。

一言で言えば、ウォルデン氏はDAOの最初の波は、しばしば生協に似ていた、つまり人間中心のデジタル組織であり、自動化にはあまり重点を置いていなかったと指摘しています。

それにもかかわらず、ウォルデン氏は、 人工知能の新たな進歩、特に大規模言語モデル(LLM)や生成モデル(Generative Model)は、現在、次のようなことを主張し続けています。と生成モデルは、現在、ヴィタリックが10年前に予見した分散型の自律性をよりよく可能にすることを約束しています。

しかし、DAOの実験がAIエージェントをますます採用するにつれて、私たちはここで新たな意味合いと問題に直面することになります。以下では、DAOがそのアプローチにAIを組み込む際に対処しなければならない5つの重要な領域を見ていきましょう。

Shifting Governance

Vitalik氏のオリジナルのフレームワークでは、DAOはチェーン上にガバナンスのルールをエンコードすることで、階層的な人間の意思決定への依存を減らすことを目的としていました。

当初、人間はまだ「縁の下の力持ち」でしたが、それでも複雑な判断には不可欠でした。ウォルデン氏の言うDAO2.0の世界では、人間はまだ端っこでうろうろしており、資本や戦略的な方向性を提供しているが、徐々に権力の中心は人間ではなくなっている。

このダイナミズムは、多くのDAOのガバナンスを再定義するだろう。人間の連合が交渉し、結果について投票することはまだ見られるでしょうが、あらゆる種類の運用上の決定は、AIモデルの学習パターンによってますます導かれるようになるでしょう。このバランスをどのように実現するかは、現在のところ未解決の問題であり、設計の余地である。

Minimising model misalignment

DAO の初期のビジョンは、透明で不変のコードで人間のバイアス、腐敗、非効率を打ち消すことを目的としていました。

現在、重要な課題は、信頼できない人間の意思決定から、AIエージェントがDAOの目標に「一致」していることを確実にすることです。ここでの主な脆弱性は、もはや人間の共謀ではなく、モデルのミスアライメントです。つまり、AI主導のDAOが、人間が期待する結果から逸脱した指標や行動に対して最適化するリスクです。

DAO2.0のパラダイムでは、この一貫性の問題は(当初はAIの安全性サークルにおける哲学的なものでしたが)、経済学やガバナンスの観点から現実的なものになります。

これは、基本的なAIツールで実験している今日のDAOにとっては包括的な問題ではないかもしれませんが、AIモデルがより高度になり、分散型ガバナンス構造に深く統合されるにつれて、精査と改良の主要な分野になると予想されます。

New attack surfaces

最近のFreysaコンテストについて考えてみましょう。このコンテストでは、人間のp0pular.ethが、AIエージェントのFreysaを騙して、その「approveTransfer」関数を誤って解釈させました。「関数を誤って解釈させ、47,000ドルの賞金を獲得しました。

Freysaの内蔵の保護機能(賞金を決して送らないという明確な指示)にもかかわらず、人間の創造性は最終的にこのモデルを出し抜き、ヒントとコードロジックの間の相互作用を利用して、AIが資金を放出するまで利用しました。AIが資金を放出するまで。

この初期のコンテストの例は、DAOがより洗練されたAIモデルを組み込むにつれて、新たな攻撃対象も継承していくことを強調しています。Vitalikが人間によるDOやDAOの共謀を恐れたように、DAO 2.0は、AIのトレーニングデータへの敵対的な入力や、即座に操作された攻撃を考慮しなければならなくなりました。

LLMの推論プロセスを操作したり、LLMに誤解を招くようなオンチェーンデータを提供したり、LLMのパラメータに微妙な影響を与えたりすることは、「ガバナンスの乗っ取り」の新しい形態となる可能性があり、戦場は人間の多数決攻撃から、より繊細で洗練された形態のAI搾取へと移ります。

New Centralisation Problems

DAO 2.0の進化は、与えられたDAOの基礎となるAIモデルを作成、訓練、制御する人々に大きな力を移しつつあり、このダイナミックな動きは、新しい形の中央集権的なチョークポイントにつながる可能性があります。

もちろん、高度なAIモデルを訓練し、維持するには、専門的な専門知識とインフラが必要であるため、将来的には、組織によっては、表向きはコミュニティの手にありながら、実際には熟練した専門家の手にあるような方向性を見ることになるでしょう。

これは理解できる。しかし今後を考えると、AI実験を追跡するDAOが、モデルの更新、パラメーターのチューニング、ハードウェアの設定といった問題にどのように対応するかが興味深いところです。

ウォルデン氏の「戦略対運用」の区別は、長期的なバランスを示唆しています:AIは日々のDAOのタスクを処理することができ、人間は戦略的な方向性を提供します。

しかし、AIモデルがより洗練されるにつれて、DAOの戦略レイヤーにも徐々に侵入してくる可能性がある。そのうちに、「縁の下の力持ち」の役割はさらに縮小するかもしれません。

このことは、次のAIを搭載したDAOの波では何が起こるのか、多くの場合、人間は資金を提供し、傍観しているだけかもしれない、という疑問を提起している。

このパラダイムでは、人間は、ブランドの共同所有から、AIが管理する自律的な経済マシンに近いものへと移行し、最も影響力のないカビの生えた投資家になるのでしょうか?

DAOのシナリオでは、人間が能動的なマネージャーではなく、受動的な株主の役割を果たす組織モデルへの傾向がより強くなると思います。しかし、人間にとって意味のある意思決定が少なくなり、オンチェーン資本を他で提供することが容易になるにつれて、コミュニティのサポートを維持することは、時間の経過とともに継続的な課題になるかもしれません。

How DAO can stay proactive

良いニュースは、上記の課題すべてに積極的に対処できるということです。たとえば、

ガバナンスに関して - DAOは、人間の投票者または人間の専門家が、特定の影響力の大きい決定を保留するために、委員会を回転させるガバナンスメカニズムを試すことができます。委員会に回して、影響の大きい決定を保留するようなガバナンスの仕組みを試すことができます。

一貫性のなさについて - 一貫性チェックを定期的な運用費用(セキュリティ監査など)として扱うことで、DAOはAIエージェントが公的目標に忠実であることを、1回限りの問題ではなく、継続的な責任として保証することができます。

中心性について - DAOはコミュニティメンバーの幅広いスキルを高めるために投資することができます。そうすることで、少数の「AIの魔術師」がガバナンスをコントロールするリスクを軽減し、技術管理への分散型アプローチを促進することができます。

サポートについて - 人間がDAOにおいてより受動的なステークホルダーとなるにつれ、これらの組織は、資本配分の目先の論理を超え、長期的なサポートを維持するために、ストーリーテリング、共有された使命、コミュニティの儀式への取り組みを強化することができます。

次に何が起こるにせよ、ここでの未来が大きく開けていることは明らかです。

Vitalik氏が最近立ち上げたDeep Fundingは、DAOの試みではありませんが、AIと人間の審査員を利用して、オープンソースのイーサリアム開発のための新しい資金調達メカニズムを開拓することを目指しています。

これは新しい試みですが、AIと分散型コラボレーションの交差点が加速しているという、より広範な傾向を浮き彫りにしています。新しいメカニズムが登場し、成熟するにつれて、DAOはますますこれらのAIのアイデアを適応させ、拡張していくことが予想されます。これらのイノベーションはユニークな課題を提示するので、今こそ準備を始める時です。

YouQuan

YouQuan

YouQuan

YouQuan YouQuan

YouQuan Joy

Joy Brian

Brian Hui Xin

Hui Xin Joy

Joy YouQuan

YouQuan Brian

Brian Hui Xin

Hui Xin Joy

Joy