ここ数カ月、人工知能が次々と表面化し、ニュースの見出しには「AIが会社のコードを流出させ、しかも単純に削除できない」「AIソフトがユーザーの顔情報のプライバシーを侵害した」「大手モデル製品が私的な会話を流出させた.などなど。

しかし、おそらくもっと深い問題は、大型モデルブームのずっと前から存在していた。Deepfakeと呼ばれるディープフェイク技術の出現だ。これは、ディープラーニングを利用して、世界中の誰でも、実際にはその場にいなかったビデオや写真にシームレスにつなぎ合わせるものだ。ディープフェイクは、ディープラーニング(深層学習)を使って、世界中の誰にでも、実際には存在しなかったビデオや写真にシームレスに合成する。

2024年の今日に至るまで、ディープフェイクの潜在的な脅威は効果的に封じ込められていない。

人工知能による詐欺は現実であり、懸念すべき原因です。

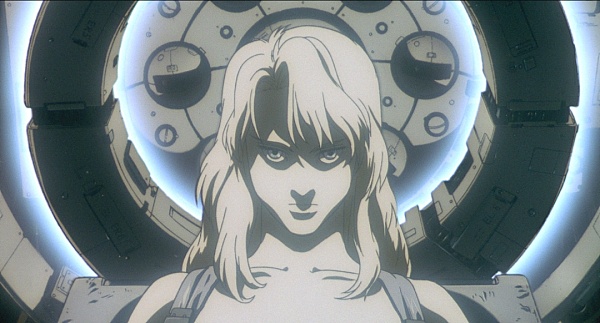

1995年のアニメ映画「進撃の巨人(ATTACK ON TITAN)」では、人形使い(Puppeteer)と名付けられたAIが他の人格になりすます方法を知っており、人間の思考や行動を混乱させ、コントロールするというプロットが描かれています。この能力により、サイバー空間や仮想空間では追跡不可能になる。このようなシナリオは映画の中でしか見たことがないが、イーロン・マスクやサム・アルトマンのような人物の警告に長い間影響を受けてきたのであれば、AIを野放しにしておけば、人類にとってスカイネットのような脅威へと発展しかねないと想像するのは必然である。

Attack on Titan Puppeteer

ありがたいことに、この懸念はAI開発者全体が共有しているわけではありません。チューリング賞受賞者のジョセフ・シファキスなど、学界のAI界の巨人の多くは、インタビューでこのアイデアを軽蔑していることを明らかにしています。現時点では、人間の知能に匹敵するどころか、道路を安全に運転できるAIもない。

だからといって、AIが無害というわけではない。

AIはこれまで作られた中で最も破壊的なツールの1つになる可能性を秘めている。私たちはこのことを、最近、AI詐欺師に2500万ドルもの詐欺を働くという不幸に見舞われた金融会社の重役から、海の向こうではなく、私たちに非常に近い香港特別行政区でよく知っている。この種のAI犯罪への対応はあるのだろうか?

Stealing the Sky

2月5日、香港メディアのRTHKによると、香港の財務責任者が、このような犯罪に巻き込まれたと主張するメールを受け取った。香港のRTHKによると、匿名の財務部長が、英国人の同僚から秘密の取引を持ちかけられたと主張するメールを受け取った。財務責任者は騙されやすい人間ではなく、一見してフィッシングではないかと疑っている。

しかし、送り主はZoomビデオ会議の手配を主張し、香港のCFOが会議に参加すると、見覚えのある同僚数人の顔と声を見聞きした。疑惑は和らぎ、彼らは取引の準備を始め、イギリス人の同僚の指示通り、2億香港ドル(現在約1億8400万人民元)を5つの現地口座に15回に分けて送金することになった。

別の従業員が本社に確認して初めて異常が発覚し、英国支社は取引を開始しておらず、資金も受け取っていないことが判明した。詐取されたと知ったときのCFOの自責の念と罪悪感を想像してみてほしい。調査の結果、ビデオ会議の本当の参加者は香港のCFOだけで、残りの参加者は英国のCFOと、Deepfakeの人工知能技術によってシミュレートされた他の同僚だったことが判明した。

公開されているわずかなデータ、AIプログラムの基本セット、そして巧妙なごまかしだけで、詐欺師たちは豪華なスーパーヨットが買えるほどの大金をだまし取ることに成功したのです。

この時点で、財務責任者があまりにずさんだったと断言し、この話を嘲笑する人もいるかもしれません。結局のところ、私たちが普段Shake ShackやYouTubeで目にするDeepfakeの「ライブ動画」は、とても簡単に見破られてしまうため、本物を偽るのは難しいのです。

しかし、現実はそれほど単純ではないかもしれない。最新の研究によると、人々は実際にはDeepfakeを確実に見分けることはできない。さらに憂慮すべきことに、この研究では、人々はディープフェイク動画をフェイクではなく本物と勘違いする可能性が高いことも明らかになっている。つまり、今日のディープフェイク技術は、視聴者を簡単に欺くことができるほど洗練されているのだ。

ディープラーニング+フェイク

「ディープフェイク(Deepfake)」という用語は、「ディープラーニング+フェイク(Deep-learning + Fake)」>の技術を指します。ディープフェイクとは、「ディープラーニング」と「フェイク」を組み合わせた言葉です。

このように、Deepfake の技術の核となる要素は機械学習であり、これによってディープなフェイクコンテンツを迅速かつ低コストで制作することが可能になります。誰かの Deepfake ビデオを制作するために、クリエイターはまず、ニューラルネットワークを訓練するために、その人物の実際のビデオクリップを大量に使用する。そして、訓練されたネットワークをコンピューターグラフィックス技術と組み合わせ、人物のレプリカを別の人物に重ね合わせた。

多くの人は、Generative Adversarial Networks(GAN)と呼ばれるディープラーニングアルゴリズムのクラスが、将来的にDeepfake s技術の主要な原動力になると考えており、GANは実際の顔とほとんど見分けがつかない顔画像を生成する。

2017年末、「deepfakes」と呼ばれるRedditユーザーが、多くの有名映画スターや要人までもの顔を使ってポルノ動画を変換した。をポルノ動画に変換し、インターネット上に投稿した。この種のフェイク動画は瞬く間にソーシャルネットワーク上で拡散し、それ以来、大量の新しいディープフェイク動画が出現するようになったが、対応する検出技術が登場したのはそれから数年後のことだった。

しかし、肯定的な例もある。Deepfakeが観客に初めて知られるようになったのは、『ワイルド・スピード7』で故ポール・ウォーカーが生き返ったときであり、2023年の大晦日映画『さすらいの世界2』でも使われた。2023年の春節映画『ストレイト・アース2』でも、CG技術を使って人気の "タットおじさん "ウー・メンダが再現された。しかし以前であれば、このような効果を生み出すのに専門家のスタジオ全体で1年はかかっただろう。

今日では、そのプロセスはかつてないほど速くなり、技術について何も知らない一般人でも、「AI顔交換」ビデオを数分で作成できるようになった。

Deepfake を心配する声が急増した。2020年当時、MetaやXを含むソーシャルメディアプラットフォームは、同様のDeepfake製品をネットワークから禁止した。また、主要なコンピュータビジョンやグラフィックスのカンファレンスでは、専門家がステージに招かれ、防御方法について語りました。

Deepfakeの犯罪者たちが大規模に世界を欺き始めた今、私たちはどのように反撃すればいいのでしょうか?

Deepfakeのリスクから身を守るマルチツール

何よりもまず。戦略は、AIに「毒を盛る」ことです。リアルなDeepfakeを作成するには、攻撃者は、ターゲットの多数の写真、表情の変化を示す多数のビデオクリップ、明瞭な音声サンプルなど、膨大な量のデータを必要とします。ほとんどのDeepfakeテクニックは、個人または企業がソーシャルメディアで公に共有している素材を利用しています。

しかし、現在ではNightshadeやPhotoGuardのように、人間の知覚に影響を与えることなくこれらのファイルを変更できるプログラムもあり、Deepfakeは効果を発揮しません。例えば、Nightshadeは、AIに誤解を招くような処理によって、写真の顔領域を誤認させ、この誤認は、Deepfakeの構築の背後にあるAIの学習メカニズムを正確に混乱させる可能性があります。

第二に、あなたやあなたの組織がオンラインで公開するすべての写真や動画に対してこのような保護を行うことで、Deepfakeのクローンを効果的に防ぐことができます。しかし、この方法は確実ではなく、むしろ絶え間ない戦いになります。AIが改ざんされたファイルを認識する能力を向上させるにつれて、Deepfake対策プログラムは、効果を維持するために新しい方法を開発する必要があります。

より強固な防御を構築するには、簡単に破られる認証方法に頼ることから脱却する必要があります。この記事のケースでは、問題の財務責任者はビデオ通話を本人であることの絶対的な確認と見なしましたが、二次認証のために本社や英国支店の他の人物に電話をかけるなどの追加措置を講じませんでした。実際には、オンライン認証の信頼性を確保するために、すでに秘密鍵暗号化を利用 しているプログラムもある。この種の詐欺の可能性を大幅に減らすために、複数の認証ステップを採用することは、すべての組織が直ちに実行に移すべきことです。

ですから、次にビデオ会議に参加したり、同僚や友人、家族から電話を受けたりするときは、画面の向こう側にいる人が実在しない可能性があることを心に留めておくことが大切です。特に、2,500万ドルを前代未聞の奇妙な銀行口座に密かに送金するよう求められているのなら、まず上司に電話するのが最低限のマナーだ。

Joy

Joy

Joy

Joy Alex

Alex Sanya

Sanya Joy

Joy Hui Xin

Hui Xin Catherine

Catherine Jasper

Jasper Joy

Joy Kikyo

Kikyo Bitcoinist

Bitcoinist