AIが人類を転覆させる第一歩:人の心を読む

AIに関する大きな議論の中で、人々はAIに最も効率的なアシスタントか、あるいは我々を転覆させる「機械の軍団」のどちらかの役割を割り当てている。AIは人間から与えられたタスクをこなすだけでなく、人の心を「読む」こともできるはずで、この人の心を読む能力が今年のAI分野の主な焦点となっている。

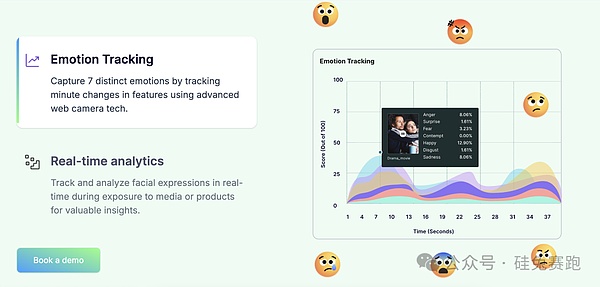

PitchBookによる今年のエンタープライズSaasにおける新技術の調査では、「感情AI」が主要な技術の目玉となりました。これは、感情コンピューティングとAI技術を使用して人間の感情を知覚、理解、対話することを指し、テキスト、表情、音声、その他の生理学的信号を分析することによって人間の感情を理解しようとするものです。つまり、感情AIとは、機械が人間と同じように、あるいはそれ以上に感情を「読み取る」ことができるようになることを期待しているのだ。

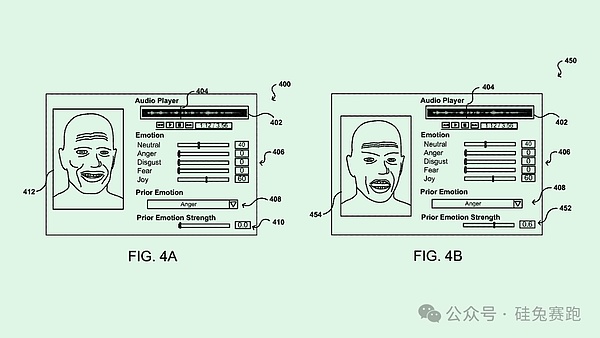

主な技術は以下の通り:

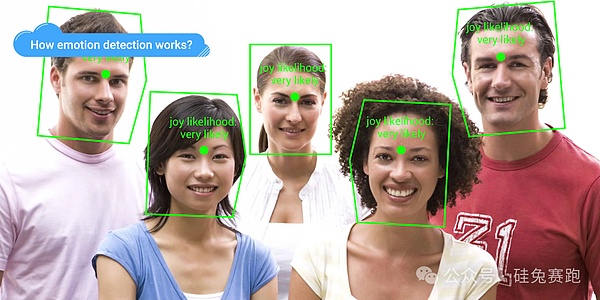

表情分析。strong>:カメラ、コンピュータビジョン、ディープラーニングにより、微小な表情や表情筋の動きを検出します。

音声分析:声紋、トーン、リズムから感情の状態を特定する。

テキスト分析:自然言語処理(NLP)技術の助けを借りて、発言と文脈を解釈します。

Physiological Signal Monitoring: ウェアラブルを使用して心拍数や皮膚反応などを分析し、パーソナライゼーションや感情的な豊かさを強化します。

エモーションAI

:心拍数や皮膚の反応などをウェアラブルで分析し、パーソナライゼーションと感情的な豊かさを高めます。Emotion AI

EmotionAIの前身はセンチメント分析技術であり、ソーシャルメディア上のテキストを通じたユーザー感情の分析・抽出など、主にテキストインタラクションを分析します。完全なセンチメント分析になることを約束します。

VCs Spilling Money, Startups Getting Huge Funding

Silicon Bunnyは、感情AIの可能性が多くの投資家の注目を集めており、この分野に注力しているスタートアップが数多くあると見ています。Uniphore、MorphCastなどの企業は、すでにこの分野で多額の投資を受けています。

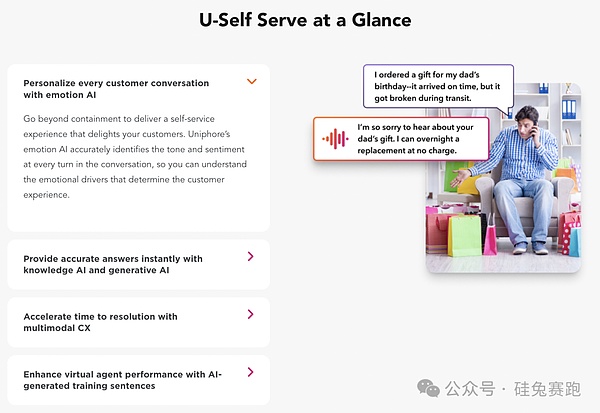

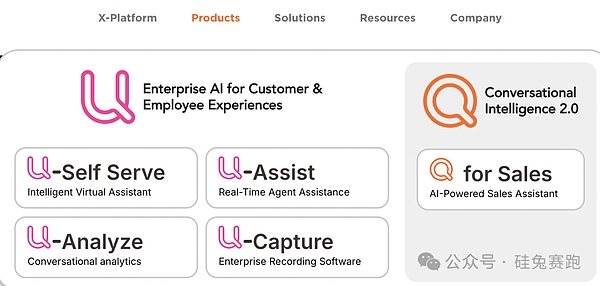

カリフォルニアを拠点とするUniphoreは、2008年から企業向けの自動対話ソリューションを模索しており、U-Self Serve、U-Assist、U-Capture、U-Analyzeなどの製品ラインを開発している。U-Self Serveは、会話中の感情や口調を正確に識別することに重点を置いており、企業はよりパーソナライズされたサービスを提供し、ユーザーのエンゲージメント満足度を向上させることができます。

U-Self Serve

ユニフォアのテクノロジーは、機械が言語を理解することを可能にするだけでなく、人間と対話する際に声のトーンや表情の裏に隠された感情を捉え、解釈できることを期待しています。この能力により、組織は機械的な対応にとどまらず、顧客と対話する際に顧客の感情的なニーズをよりよく満たすことができます。ユニフォアを使用することで、組織は87%のユーザー満足度と30%のカスタマーサービスパフォーマンスの向上を達成することができました。

ユニフォアはこれまでに6億2000万ドル以上の資金を調達しており、直近のラウンドは2022年にNEAが主導した4億ドルで、マーチ・キャピタルなどの既存投資家も参加しており、このラウンド後の評価額は25億ドルとなっている。

ユニフォア

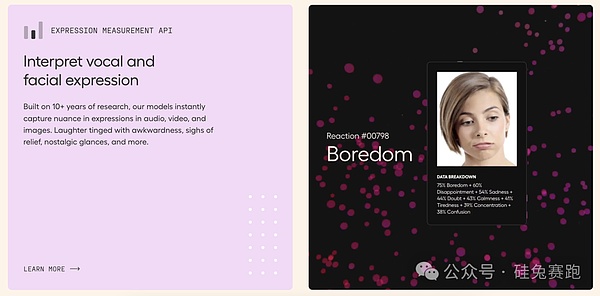

ヒュームAIは、世界初の共感音声AIを発表した。コーウェン氏の研究は、『ネイチャー』誌や『トレンド・イン・認知科学』誌など数多くの学術誌に掲載され、これまでに研究された感情のサンプルの中で最も幅広く多様なものをカバーしている。この研究に後押しされ、ヒュームは会話音声APIであるEVIを開発しました。EVIは、大規模な言語モデルと共感アルゴリズムを組み合わせて、人間の感情状態を深く理解・解析し、音声中の感情を認識するだけでなく、ユーザーとの対話において、よりニュアンスのあるパーソナライズされた応答を提供します。開発者は、わずか数行のコードでこれらの機能を使用し、あらゆるアプリケーションに組み込むことができます。

ヒュームAI

現在のほとんどのAIシステムの主な限界の1つは、その指示が主に人間によって行われることであり、エラーが起こりやすく、AIの大きな可能性を引き出すことができない。 ヒュームの共感的大規模言語モデル(eLLM)は、ユーザーの感情の言葉やトーンを文脈やユーザーの気分に適応させる。人間の幸福を機械学習、調整、インタラクションの第一原理とすることで、ヒュームは、文脈とユーザーの感情表現に基づいて言葉や声のトーンを調整する共感的大規模言語モデル(eLLM)を開発し、メンタルヘルス、教育・トレーニング、救急コール、ブランド分析などのさまざまな場面で、より自然で本物の体験を提供している。今年3月、ヒュームAIはEQTベンチャーズが主導する5,000万ドルのシリーズBラウンドの資金調達を完了し、ユニオン・スクエア・ベンチャーズ、ナット・フリードマン、ダニエル・グロスらも投資した、Metaplanet、Northwell Holdingsなどが名を連ねている。

また、この分野ではEntropikが消費者の認知的・感情的反応を測定することを専門としており、感情AI、行動AI、生成AI、予測AIの総合力を組み合わせたDecodeを通じて、消費者の行動や嗜好をよりよく理解し、より高度なサービスを提供することができます。Entropikは最近、SIG Venture CapitalやBessemer Venture Partnersなどの投資家から、2023年2月に2500万ドルのシリーズB資金調達ラウンドを完了した。

Entropik

この感情AIの分野では、それぞれの強みを持つテクノロジー専攻の選手も活躍している。

Microsoft Azure Cognitive ServicesのEmotion APIを含め、表情や感情を分析することで、写真や動画から喜び、怒り、悲しみ、驚きなど、さまざまな感情を認識することができます

IBMワトソンの自然言語理解APIは、大量のテキストデータを処理して、根底にある感情の傾向(肯定的、否定的、中立的など)を特定し、ユーザーの意図をより正確に解釈することができます;

。

GoogleのクラウドAI Cloud Vision APIは、画像内の感情表現を素早く特定できる強力な画像分析機能を持ち、テキスト認識と感情相関をサポートします。

AWSのRekognitionは、感情の検出、顔の特徴の認識、表情の変化の追跡も可能で、他のAWSサービスと組み合わせて、完全なソーシャルメディア分析や感情AIを活用したマーケティングアプリとして使用できます。

Cloud Vision API<

一部のスタートアップは、感情AIの領域でさらに速く動いており、テック大手が「ポシェット」しているほどだ。たとえば、ユニコーンInflection AIは、そのAI作業で投資家マイクロソフトに目をつけられている。例えば、ユニコーンInflection AIは、ビル・ゲイツ、エリック・シュミット、NVIDIAとともに13億ドルを投資したマイクロソフトから、AIの第一人者でInflection AIの共同設立者の一人であるムスタファ・スレイマンにオリーブの枝を投げられた。スレイマンは70人以上の従業員とともにマイクロソフトに移籍し、マイクロソフトはこのプロジェクトに約6億5000万ドルを支払った。

しかし、Inflection AIはすぐに再編成を行い、Google翻訳、AIコンサルティング、ARの経歴を持つ新しいチームを結成し、主力製品であるPi(ユーザーの感情を理解し反応するパーソナルアシスタント)の開発を継続した。Piは、ユーザーとの感情的なつながりを確立することに重点を置き、音声、テキスト、その他の入力を分析することで感情を感知し、会話の中で共感を示す。Inflection AIは、Piを単なるAIアシスタントではなく、コーチ、親友、聞き手、創造的なパートナーとして捉えている。加えて、Piは強力なメモリを持っており、相互作用の継続性を高め、経験をパーソナライズする方法として、ユーザーの複数の会話の履歴を記憶する。

抑揚AI Pi<

開発への道のり、懸念と疑問

感情的AIは、より人間的な人々との関わり方を約束する一方で、他のAI技術と同様に、その展開には懸念と疑問の両方が伴う。まず、感情AIは本当に人間の感情を正確に解釈できるのだろうか?理論的には、このテクノロジーは確かにサービスやデバイス、テクノロジーの体験をより豊かなものにすることができるが、現実的な観点から見ると、人間の感情は本質的に曖昧で主観的なものであり、2019年の時点で、一部の研究者はこのテクノロジーに疑問を呈していた。表情は人間の真の感情を確実に反映するものではないため、人間の表情や体の姿勢、イントネーションを理解するために、機械だけに頼ってシミュレーションを行うことはできないとしている。感情を理解するために、人間の表情、体の姿勢、イントネーションを模倣する機械だけに頼ることには限界がある。第二に、厳しい規制がAI開発への道の足かせとなっている。例えば、EUのAI法は、教育などの分野でのコンピュータビジョンによる感情検出システムの使用を禁止しており、そのため特定の感情AIソリューションの推進が制限される可能性がある。また、米国のイリノイ州は、許可なく生物学的根拠に基づくテストを禁止する法律を制定している。米国のイリノイ州やその他の州には、許可なく生体データを収集することを禁止する法律があり、感情AIに特定の技術を使用する前提を直接的に制限している。同時に、データのプライバシーと保護は重要な問題であり、感情AIは通常、データプライバシー要件の教育、健康、保険および他の分野で使用され、特に厳しいので、感情データのセキュリティと合法的な使用を確保するために、すべての感情AI企業が問題に直面する必要があります。

最後に、異なる文化圏の人々の間のコミュニケーションと感情の解釈は難しい問題であり、AIにとってはさらに試練である。 例えば、地域によって感情の理解や表現方法が異なるため、感情AIシステムの有効性と完全性に影響を与える可能性があり、さらに、感情AIは人種、性別、性別を扱う際に同じ課題に直面しない可能性がある。さらに、感情AIは人種、性別、性自認の偏りに対処する際にもかなりの困難に直面する可能性がある。

感情AIは、人間の労働力を削減する効率性だけでなく、人の心を読み取る思慮深さも約束してくれるが、本当に人間関係の万能ソリューションになり得るのだろうか。おそらく将来的には、AIの「読心術」が人間と機械、さらには人間の相互作用を覆すことになるのだろうが、少なくとも現時点では、人間の感情を真に理解し、それに応えるには、まだまだ人間の関与と慎重さが必要なのかもしれない。

ソース:

Uniphore、ヒューマン・マシン・インタラクション向けに4億ドルのユニファーマ資金調達を発表Uniphore Announces $400 Million Series E (Uniphore)

Hume AI Announces $50 Million Fundraise and EmpathicVoice Interface(Yahoo Finance)

あなたのパーソナルAI「Pi」を紹介(Inflection AI)

Hume AIが5000万ドルの資金調達と共感インターフェースを発表(Yahoo Finance)

「Emotion AI」はビジネスソフトウェアの次のトレンドになるかもしれないが、それは問題かもしれない(TechCrunch)<

EMERGING TECH RESEARCH Enterprise Saas Report(PitchBook)

Alex

Alex

Alex

Alex Aaron

Aaron Jasper

Jasper Joy

Joy Kikyo

Kikyo Clement

Clement Joy

Joy Hui Xin

Hui Xin YouQuan

YouQuan Clement

Clement