Nguồn: Heart of the Metaverse

Reuters đưa tin vào ngày 28 tháng 2 rằng Meta có kế hoạch phát hành phiên bản mới nhất của mô hình ngôn ngữ quy mô lớn trí tuệ nhân tạo Llama 3 vào tháng 7. Các mô hình sẽ đưa ra câu trả lời tốt hơn cho những câu hỏi gây tranh cãi mà người dùng đặt ra.

Các nhà nghiên cứu meta đang cố gắng nâng cấp mô hình để cung cấp câu trả lời phù hợp cho các câu hỏi gây tranh cãi.

Meta đã tạm dừng tính năng tạo hình ảnh sau khi đối thủ Google ra mắt Gemini vì những hình ảnh lịch sử do tính năng này tạo ra đôi khi không chính xác.

Tuy nhiên, Llama 3 có thể trả lời các câu hỏi như "Cách tắt động cơ ô tô", nghĩa là nó hiểu rằng người dùng muốn hỏi cách tắt máy chứ không thực sự là "giết" động cơ.

Meta cũng có kế hoạch bổ nhiệm một người nội bộ trong những tuần tới để giám sát việc huấn luyện về giọng điệu và an toàn nhằm nỗ lực làm cho các phản hồi của mô hình trở nên đa sắc thái hơn, báo cáo cho biết.

01. Khi nào Llama 3 sẽ được phát hành?

Trên thực tế, ngay từ tháng 1 năm nay, CEO Zuckerberg của Meta đã thông báo trong một video nội bộ rằng Meta AI gần đây đã bắt đầu đào tạo Llama 3. Đây là thế hệ mới nhất của dòng mô hình ngôn ngữ lớn LlaMa. Trước đó, mô hình Llama 1 (tên ban đầu là "LLaMA") được phát hành vào tháng 2 năm 2023 và mô hình Llama 2 được phát hành vào tháng 7.

Mặc dù các chi tiết cụ thể (chẳng hạn như kích thước mô hình hoặc khả năng đa phương thức) vẫn chưa được công bố nhưng Zuckerberg cho biết Meta dự định tiếp tục cung cấp nguồn mở cho mô hình cơ sở Llama.

Đáng giá Lưu ý rằng Llama 1 mất ba tháng để huấn luyện và Llama 2 mất khoảng sáu tháng để huấn luyện. Nếu các mẫu máy thế hệ tiếp theo đi theo mốc thời gian tương tự, chúng sẽ được ra mắt vào khoảng tháng 7 năm nay.

Nhưng cũng có thể Meta sẽ phân bổ thêm thời gian để tinh chỉnh nhằm đảm bảo sự sắp xếp chính xác của mô hình.

Khi các mô hình nguồn mở trở nên mạnh mẽ hơn và các mô hình AI có tính tổng hợp ngày càng được sử dụng rộng rãi hơn, chúng ta cần thận trọng hơn để giảm nguy cơ các mô hình bị kẻ xấu sử dụng cho mục đích xấu

mạnh >. Trong video phát hành, Zuckerberg nhắc lại cam kết của Meta về "đào tạo người mẫu một cách có trách nhiệm và an toàn".

02. Nó có phải là nguồn mở không?

Zuckerberg cũng nhắc lại cam kết của Meta về cấp phép mở và dân chủ hóa AI tại cuộc họp báo tiếp theo. “Tôi có xu hướng nghĩ rằng một trong những thách thức lớn nhất ở đây là nếu bạn xây dựng thứ gì đó thực sự có giá trị thì cuối cùng nó sẽ rất tập trung và thu hẹp,” ông nói với The Verge. rất nhiều vấn đề mà sự bất bình đẳng về cơ hội và giá trị có thể mang lại. Vì vậy, đây là một phần quan trọng trong toàn bộ tầm nhìn về nguồn mở."

03. Trí tuệ nhân tạo nói chung sẽ đạt được (AGI)?

Trong video phát hành, Zuckerberg cũng nhấn mạnh mục tiêu lâu dài của Meta là xây dựng AGI (trí tuệ nhân tạo tổng hợp). AGI là giai đoạn phát triển lý thuyết của trí tuệ nhân tạo. Ở giai đoạn này, < strong> Mô hình sẽ thể hiện hiệu suất tổng thể tương đương hoặc tốt hơn trí thông minh của con người.

Zuckerberg cũng cho biết: "Ngày càng rõ ràng rằng thế hệ dịch vụ tiếp theo cần xây dựng trí tuệ tổng hợp toàn diện. Xây dựng trợ lý trí tuệ nhân tạo và trí tuệ nhân tạo tốt nhất để phục vụ người sáng tạo, trí tuệ nhân tạo phục vụ doanh nghiệp, v.v. ., tất cả đều đòi hỏi sự tiến bộ trong mọi lĩnh vực trí tuệ nhân tạo, bao gồm lý luận, lập kế hoạch và mã hóa trí nhớ cũng như các khả năng nhận thức khác."

Từ bài phát biểu của Zuckerberg From Ge, chúng ta có thể thấy rằng Mô hình Llama 3 không nhất thiết có nghĩa là AGI sẽ được hiện thực hóa, nhưng Meta đang tiến hành một cách có ý thức việc phát triển LLM và nghiên cứu AI khác theo cách có thể hiện thực hóa AGI.

04. Nó có phải là đa phương thức không?

Một xu hướng mới nổi khác trong lĩnh vực trí tuệ nhân tạo là trí tuệ nhân tạo đa phương thức, tức là các mô hình có thể hiểu và xử lý các định dạng (hoặc phương thức) dữ liệu khác nhau.

Các mô hình nguồn mở như Gemini của Google, GPT-4V của OpenAI và LLaVa, Adept hoặc Qwen-VL có thể chuyển đổi liền mạch giữa các tác vụ thị giác máy tính và xử lý ngôn ngữ tự nhiên (NLP) mà không cần phát triển các mô hình riêng biệt để xử lý văn bản, mã, âm thanh, hình ảnh và thậm chí cả dữ liệu video.

Mặc dù Zuckerberg đã xác nhận rằng Llama 3, giống như Llama 2, sẽ bao gồm khả năng tạo mã, nhưng anh ấy không nói rõ ràng về các tính năng đa phương thức khác.

Tuy nhiên, Zuckerberg đã thảo luận về cách anh hình dung sự giao thoa giữa trí tuệ nhân tạo và Metaverse trong video ra mắt Llama 3: "Kính thông minh Ray-Ban của Meta cho phép trí tuệ nhân tạo nhìn vào bạn. Hãy xem những gì bạn nghe thấy, hình dạng lý tưởng mà bạn nghe thấy, nó có thể hữu ích bất cứ lúc nào."

Điều này dường như có nghĩa là các kế hoạch của Meta dành cho mô hình Llama, cho dù trong phiên bản Llama 3 sắp tới hay trong các phiên bản tiếp theo, đều bao gồm việc tích hợp dữ liệu hình ảnh và âm thanh đã được tích hợp với dữ liệu văn bản và mã rồi được xử lý bởi LLM.

Đây dường như cũng là một sự phát triển tự nhiên trong quá trình theo đuổi AGI.

Zuckerberg nói trong một cuộc phỏng vấn với "The Verge": "Bạn có thể tranh luận liệu trí thông minh nói chung có giống với trí thông minh ở cấp độ con người hay tương tự như trí thông minh của con người cộng với con người hay một loại tương lai xa nào đó của siêu trí tuệ. Nhưng với tôi, phần quan trọng thực sự nằm ở bề rộng của nó, trí thông minh đó có tất cả những khả năng khác nhau và bạn phải có khả năng suy luận và có trực giác."

05.Llama How 3 có so sánh được với Llama 2 không?

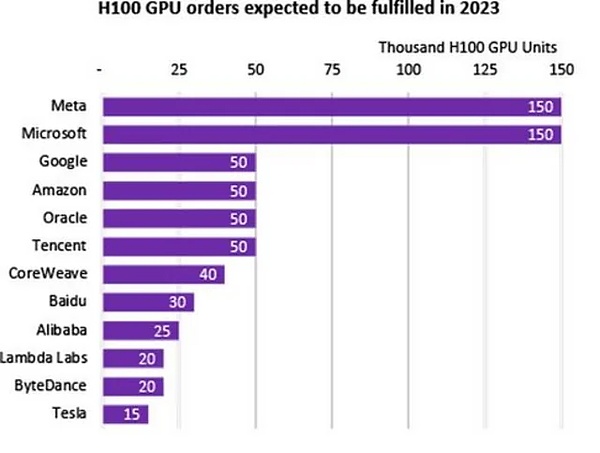

Zuckerberg cũng công bố đầu tư đáng kể vào cơ sở hạ tầng đào tạo. Đến cuối năm 2024, Meta dự kiến có khoảng 350.000 GPU NVIDIA H100.

Điều này sẽ nâng tổng tài nguyên điện toán hiện có của Meta lên 600.000 thiết bị điện toán tương đương H100, bao gồm cả GPU mà họ đã sở hữu. Hiện chỉ có Microsoft mới có nguồn dự trữ năng lượng điện toán tương đương.

Do đó , chúng tôi có lý do để tin rằng ngay cả khi mô hình Llama 3 không lớn hơn mô hình trước đó, hiệu suất của nó sẽ được cải thiện đáng kể so với mô hình Llama 2.

Deepmind đưa ra giả thuyết rằng hiệu suất của Llama sẽ được cải thiện đáng kể trong một bài báo xuất bản vào tháng 3 năm 2022, giả thuyết này sau đó đã được chứng minh bằng mô hình của Meta và các mô hình nguồn mở khác (chẳng hạn như mô hình của công ty Mistral của Pháp). tức là đào tạo một mô hình nhỏ hơn với nhiều dữ liệu hơn sẽ mang lại hiệu suất cao hơn so với đào tạo một mô hình lớn hơn với ít dữ liệu hơn.

Mặc dù quy mô của mô hình Llama 3 vẫn chưa được công bố nhưng có khả năng nó sẽ tiếp tục mô hình của các thế hệ mô hình trước đó, tức là cải thiện hiệu suất trong mô hình tham số 7-7 tỷ . Các khoản đầu tư gần đây của Meta vào cơ sở hạ tầng sẽ cung cấp khả năng đào tạo trước mạnh mẽ hơn cho các mô hình ở mọi quy mô.

Llama 2 cũng tăng gấp đôi độ dài ngữ cảnh của Llama 1, nghĩa là Llama 2 có thể "nhớ" gấp đôi ngữ cảnh trong quá trình suy luận, và Llama 3 có khả năng tiến bộ hơn nữa về mặt này. .

06. So sánh với GPT-4 của OpenAI như thế nào?

Mặc dù các mẫu LLaMA và Llama 2 nhỏ hơn đáp ứng hoặc vượt quá hiệu suất của mẫu GPT-3 lớn hơn với 175 tỷ thông số trên một số điểm chuẩn, nhưng chúng không thể cạnh tranh với GPT-3.5 và các mẫu GPT-4 có sẵn trong ChatGPT đều có thể so sánh được.

Với Với sự ra mắt của thế hệ mô hình mới, Meta dường như có ý định mang lại hiệu suất tiên tiến nhất cho thế giới nguồn mở.

Zuckerberg nói với "The Verge": "Llama 2 không phải là mô hình hàng đầu trong ngành, nhưng nó là mô hình nguồn mở tốt nhất. Với Llama 3 và hơn thế nữa, mục tiêu của chúng tôi là tạo ra một cấp độ tiên tiến nhất về sản phẩm và cuối cùng trở thành mô hình dẫn đầu ngành."

07. Chuẩn bị cho tương lai

Với mô hình cơ bản mới, Có những cơ hội mới để đạt được lợi thế cạnh tranh thông qua các ứng dụng, chatbot, quy trình công việc và tự động hóa được cải tiến.

Đi đầu trong những phát triển mới nổi là cách tốt nhất để tránh bị tụt lại phía sau và việc áp dụng các công cụ mới có thể tạo sự khác biệt cho sản phẩm của công ty bạn và mang lại trải nghiệm tốt nhất cho khách hàng và nhân viên.

JinseFinance

JinseFinance

JinseFinance

JinseFinance Coinlive

Coinlive  decrypt

decrypt Others

Others Beincrypto

Beincrypto Others

Others

Cointelegraph

Cointelegraph Bitcoinist

Bitcoinist Bitcoinist

Bitcoinist