Tác giả: Eugene Cheah Biên soạn: J1N, Techub News

Chi phí sức mạnh điện toán AI giảm sẽ truyền cảm hứng các công ty khởi nghiệp Cuộc đua đổi mới bằng cách sử dụng các nguồn lực chi phí thấp.

Do nguồn cung năng lượng tính toán AI khan hiếm vào năm ngoái, giá thuê H100 cao tới 8 USD mỗi giờ, nhưng hiện tại đã có tình trạng dư cung sức mạnh tính toán trên thị trường và giá đã giảm xuống dưới 2 USD mỗi giờ. Điều này là do một số công ty đã ký hợp đồng cho thuê sức mạnh máy tính trong giai đoạn đầu. Để tránh lãng phí sức mạnh máy tính dư thừa, họ bắt đầu bán lại tài nguyên máy tính dự trữ của mình. Hầu hết thị trường đã chọn sử dụng các mô hình nguồn mở, dẫn đến nhu cầu giảm. cho các mẫu mới. Nguồn cung H100 trên thị trường hiện vượt xa nhu cầu nên thuê H100 sẽ tiết kiệm chi phí hơn là mua và đầu tư vào H100 mới không còn sinh lời nữa.

Lược sử cạnh tranh AI

Giá thị trường năng lượng tính toán GPU đã tăng vọt. Giá thuê ban đầu của H100 là về Mỹ 4,70 USD một giờ, tăng lên tới hơn 8 USD. Điều này là do những người sáng lập dự án phải nắm bắt thời gian để đào tạo các mô hình AI của họ nhằm đạt được vòng cấp vốn tiếp theo và thuyết phục các nhà đầu tư.

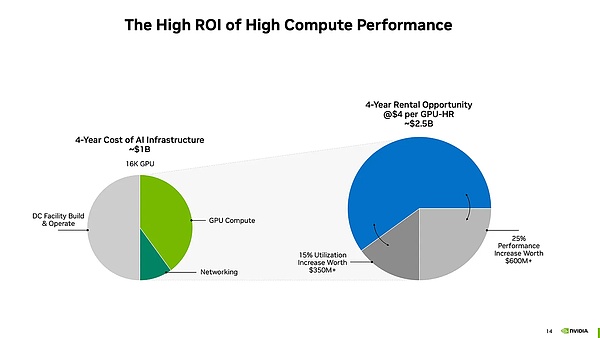

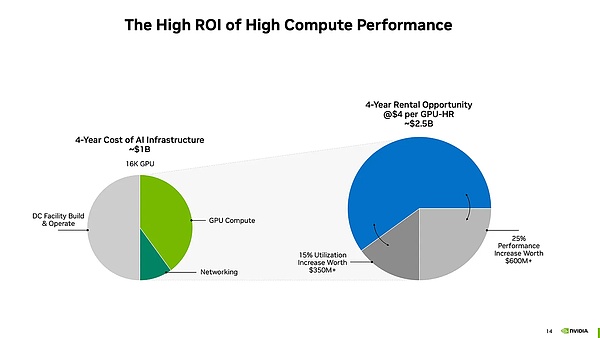

ChatGPT sẽ ra mắt vào tháng 11 năm 2022 và sử dụng dòng GPU A100. Đến tháng 3 năm 2023, NVIDIA tung ra dòng GPU H100 mới. Trong đợt khuyến mãi của mình có đề cập rằng hiệu năng của H100 mạnh gấp 3 lần A100 nhưng giá chỉ cao hơn A100 2 lần.

Đây là một sức hút rất lớn đối với các công ty khởi nghiệp AI. Bởi vì hiệu suất của GPU quyết định trực tiếp đến tốc độ và quy mô của các mô hình AI mà chúng có thể phát triển. Hiệu suất mạnh mẽ của H100 có nghĩa là các công ty này có thể phát triển các mô hình AI nhanh hơn, lớn hơn và hiệu quả hơn trước, thậm chí có khả năng bắt kịp hoặc vượt qua các công ty dẫn đầu ngành như OpenAI. Tất nhiên, tất cả điều này đều giả định rằng họ có đủ vốn để mua hoặc thuê một số lượng lớn H100.

Do hiệu suất được cải thiện đáng kể của H100 và sự cạnh tranh khốc liệt trong lĩnh vực AI, nhiều công ty khởi nghiệp đã đầu tư số tiền khổng lồ để bắt kịp H100 và sử dụng nó để đẩy nhanh quá trình đào tạo mô hình của họ. Nhu cầu tăng vọt này khiến giá thuê H100 tăng vọt, ban đầu bắt đầu ở mức 4,70 USD một giờ nhưng sau đó tăng lên hơn 8 USD.

Sở dĩ các công ty khởi nghiệp này sẵn sàng trả giá thuê cao là vì họ mong muốn nhanh chóng đào tạo người mẫu để thu hút sự chú ý của các nhà đầu tư và giành được vòng tài trợ tiếp theo Hàng trăm triệu đô la được tài trợ để tiếp tục mở rộng hoạt động kinh doanh của họ.

Đối với các trung tâm điện toán (trang trại) có số lượng GPU H100 lớn thì nhu cầu thuê GPU rất cao, giống như “tiền đến tận nhà”. Nguyên nhân là do các công ty khởi nghiệp AI này rất muốn thuê H100 để đào tạo mô hình của mình, thậm chí sẵn sàng trả trước tiền thuê. Điều này có nghĩa là các trang trại GPU có thể cho thuê GPU của họ với giá 4,70 USD mỗi giờ (hoặc hơn) trong thời gian dài.

Theo tính toán, nếu họ có thể tiếp tục thuê GPU với mức giá này thì thời gian hoàn vốn cho khoản đầu tư mua H100 của họ (tức là thời gian thu hồi vốn mua chi phí) sẽ ít hơn 1,5 năm. Sau thời gian hoàn vốn, mỗi GPU có thể tạo ra dòng tiền ròng hơn 100.000 USD mỗi năm.

Khi nhu cầu về H100 và các GPU hiệu suất cao khác tiếp tục tăng cao, các nhà đầu tư vào trang trại GPU nhận thấy tỷ suất lợi nhuận khổng lồ, vì vậy họ không chỉ đồng ý với phương thức kinh doanh này , và thậm chí còn đầu tư thêm để mua thêm GPU nhằm kiếm thêm lợi nhuận.

Sự điên rồ của hoa tulip: Được viết sau bong bóng đầu cơ đầu tiên trong lịch sử được ghi lại, giá hoa tulip tiếp tục tăng vào năm 1634 và sụp đổ vào tháng 2 năm 1637< /p>

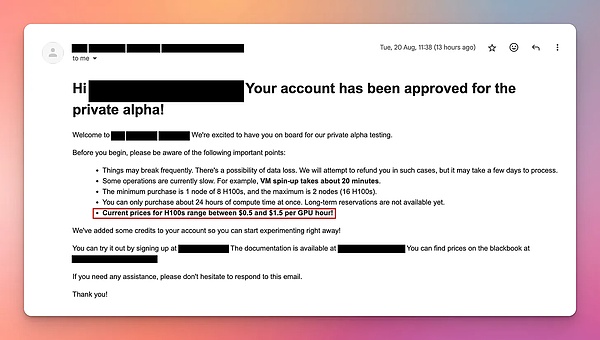

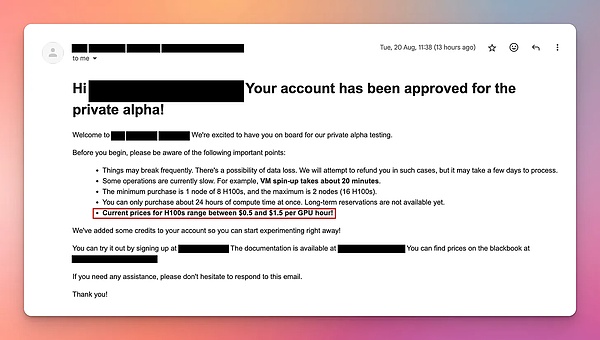

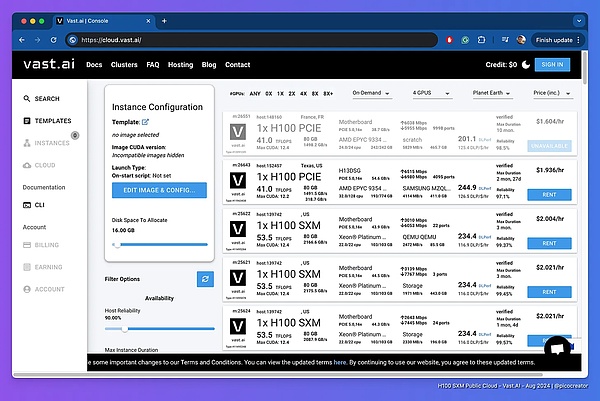

Với sự phát triển của trí tuệ nhân tạo và nhu cầu xử lý dữ liệu lớn, các doanh nghiệp ngày càng có nhu cầu về GPU hiệu suất cao (đặc biệt là H100 của NVIDIA). Để hỗ trợ các nhu cầu tính toán chuyên sâu này nhằm đáp ứng nhu cầu Theo sứ mệnh của mình, các công ty toàn cầu bước đầu đã đầu tư khoảng 600 tỷ USD vào phần cứng và cơ sở hạ tầng để mua GPU, xây dựng trung tâm dữ liệu, v.v. nhằm nâng cao khả năng tính toán. Tuy nhiên, do sự chậm trễ của chuỗi cung ứng, giá H100 vẫn ở mức cao trong suốt năm 2023, thậm chí vượt quá 4,70 USD một giờ, trừ khi người mua sẵn sàng trả trước một khoản lớn. Đến đầu năm 2024, khi có nhiều nhà cung cấp tham gia thị trường hơn, giá thuê H100 giảm xuống còn khoảng 2,85 USD, nhưng tôi bắt đầu nhận được nhiều email quảng cáo khác nhau, phản ánh sự cạnh tranh ngày càng tăng khi nguồn cung trên thị trường tăng lên.

Mặc dù giá thuê GPU H100 ban đầu dao động từ 8 USD đến 16 USD mỗi giờ nhưng đến tháng 8 năm 2024, giá thuê theo kiểu đấu giá đã giảm xuống còn 1 USD đến 2 USD mỗi giờ. Giá thị trường được dự đoán sẽ giảm từ 40% trở lên mỗi năm, vượt xa dự báo của NVIDIA là duy trì ở mức 4 USD/giờ trong 4 năm. Việc giảm giá nhanh chóng này tạo ra rủi ro tài chính cho những người chỉ mua GPU mới giá cao vì họ có thể không bù đắp được chi phí thông qua việc thuê.

Tỷ suất lợi nhuận trên vốn khi đầu tư 50.000 USD vào H100 là bao nhiêu?

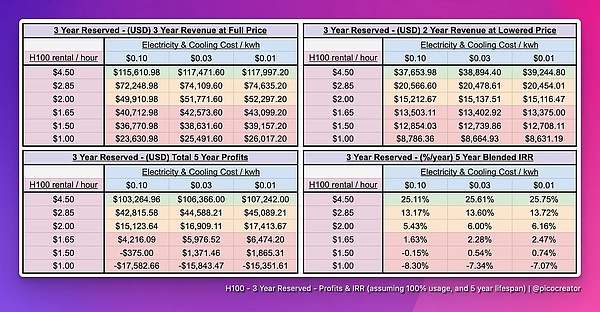

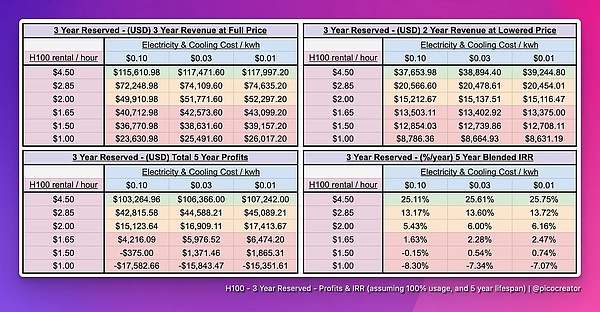

H100 có giá mua khoảng 50.000 USD, chưa tính chi phí điện và làm mát và có tuổi thọ dự kiến là 5 năm. Dịch vụ cho thuê thường có hai mô hình: cho thuê ngắn hạn theo yêu cầu và đặt phòng dài hạn. Thuê ngắn hạn đắt hơn nhưng linh hoạt hơn, trong khi đặt thuê dài hạn rẻ hơn nhưng ổn định hơn. Tiếp theo, bài viết sẽ phân tích lợi ích của hai mô hình này để tính toán xem nhà đầu tư có thể thu hồi chi phí và kiếm được lợi nhuận trong vòng 5 năm hay không.

Cho thuê ngắn hạn theo yêu cầu

Giá cho thuê và thu nhập tương ứng:

>$2,85: Vượt qua IRR của thị trường chứng khoán và đạt được lợi nhuận.

<$2,85: Thu nhập thấp hơn thu nhập từ việc đầu tư vào thị trường chứng khoán.

<$1,65: Khoản lỗ đầu tư ước tính.

Mô hình "giá hỗn hợp" dự đoán giá thuê có thể giảm tới 50% giá hiện tại trong 5 năm tới. Nếu giá thuê vẫn ở mức 4,50 USD/giờ thì tỷ suất hoàn vốn đầu tư (IRR) là trên 20%, tức là có lãi; nhưng khi giá giảm xuống còn 2,85 USD/giờ thì IRR chỉ còn 10% và tỷ suất hoàn vốn giảm đáng kể. Nếu giá giảm xuống dưới 2,85 USD, lợi nhuận đầu tư thậm chí có thể thấp hơn lợi nhuận của thị trường chứng khoán và khi giá giảm xuống dưới 1,65 USD, các nhà đầu tư có nguy cơ mất tiền nghiêm trọng, đặc biệt đối với những người gần đây đã mua máy chủ H100.

Lưu ý: "Giá hỗn hợp" là giả định giá thuê H100 sẽ giảm dần xuống còn một nửa giá hiện tại trong 5 năm tới. Ước tính này được coi là lạc quan vì giá thị trường hiện tại đang giảm hơn 40% mỗi năm nên việc xem xét mức giảm giá là hợp lý.

Hợp đồng thuê đặt phòng dài hạn (hơn 3 năm)

Trong thời kỳ bùng nổ AI, nhiều nhà cung cấp cơ sở hạ tầng được thành lập được xây dựng dựa trên kinh nghiệm trong quá khứ, Đặc biệt, trong kỷ nguyên tiền điện tử Ethereum PoW đầu tiên, họ đã trải qua chu kỳ tăng giảm mạnh về giá cho thuê GPU, vì vậy vào năm 2023, họ đã tung ra các hợp đồng cho thuê trả trước giá cao trong 3-5 năm để chốt lợi nhuận. Những hợp đồng này thường yêu cầu khách hàng phải trả hơn 4 USD/giờ hoặc thậm chí trả trước 50 đến 100% tiền thuê. Khi nhu cầu về AI tăng cao, đặc biệt là trong lĩnh vực tạo hình ảnh, các công ty mô hình cơ bản đang cố gắng nắm bắt cơ hội thị trường và là người đầu tiên sử dụng các cụm GPU mới nhất dù đắt đỏ nhưng họ phải ký để nhanh chóng hoàn thành. mô hình mục tiêu và nâng cao khả năng cạnh tranh của họ. Tuy nhiên, khi quá trình đào tạo mô hình hoàn tất, các công ty này không cần những tài nguyên GPU này nữa nhưng họ không thể dễ dàng thoát ra do bị khóa hợp đồng. Để giảm tổn thất, họ chọn bán lại những tài nguyên GPU đã thuê này để thu hồi một phần chi phí. . Điều này dẫn đến một lượng lớn tài nguyên GPU được bán lại trên thị trường, làm tăng nguồn cung và ảnh hưởng đến giá thuê cũng như mối quan hệ cung cầu trên thị trường.

Chuỗi giá trị H100 hiện tại

Lưu ý: Chuỗi giá trị, còn được gọi là Phân tích chuỗi giá trị, mô hình chuỗi giá trị, v.v. Nó được Michael Porter đề xuất vào năm 1985 trong cuốn sách “Lợi thế cạnh tranh” của ông. Porter chỉ ra rằng doanh nghiệp phải phát triển lợi thế cạnh tranh độc đáo và tạo ra giá trị gia tăng cao hơn cho hàng hóa và dịch vụ của mình Chiến lược kinh doanh là cấu trúc mô hình kinh doanh của doanh nghiệp thành một chuỗi các quy trình giá trị gia tăng và chuỗi quy trình giá trị gia tăng này là " chuỗi giá trị”.

Chuỗi giá trị H100 từ phần cứng đến mô hình suy luận AI, các phần tham gia có thể được chia đại khái thành các loại sau

Các đại lý có năng lực: Runpod, SFCompute, Together.ai, Vast.ai, GPUlist ai, v.v.

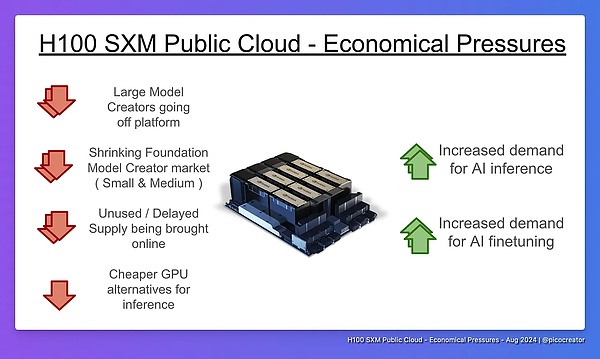

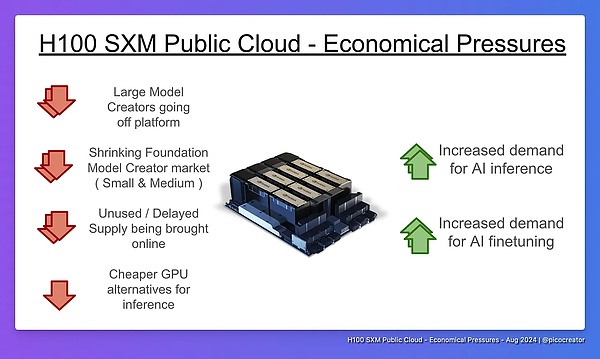

Chuỗi giá trị H100 hiện tại bao gồm từ nhà cung cấp phần cứng đến nhà cung cấp trung tâm dữ liệu, công ty phát triển mô hình AI, đại lý năng lực và dịch vụ suy luận AI nhà cung cấp và các liên kết khác. Áp lực chính trên thị trường đến từ việc các đại lý có dung lượng H100 chưa sử dụng liên tục bán lại hoặc cho thuê các tài nguyên nhàn rỗi, cũng như việc sử dụng rộng rãi các mô hình nguồn mở "đủ tốt" (chẳng hạn như Llama 3), dẫn đến nhu cầu về H100 giảm sút. Hai yếu tố này kết hợp đã dẫn đến tình trạng dư cung H100, từ đó gây áp lực giảm giá thị trường.

Xu hướng thị trường: Sự trỗi dậy của các mô hình trọng số nguồn mở

Các mô hình trọng số nguồn mở đề cập đến những mô hình có trọng số mặc dù không có phiên bản mở chính thức giấy phép nguồn Nó đã được phân phối miễn phí và sử dụng rộng rãi về mặt thương mại.

Nhu cầu sử dụng các mô hình này chủ yếu được thúc đẩy bởi hai yếu tố chính: Thứ nhất, sự xuất hiện của các mô hình nguồn mở quy mô lớn tương tự như GPT-4 ( chẳng hạn như LLaMA3 và DeepSeek-v2), thứ hai là sự trưởng thành và áp dụng rộng rãi các mô hình tinh chỉnh nhỏ (8 tỷ tham số) và cỡ trung bình (70 tỷ tham số).

Khi các mô hình nguồn mở này trở nên hoàn thiện hơn, các doanh nghiệp có thể dễ dàng tiếp thu và sử dụng chúng để đáp ứng nhu cầu của hầu hết các ứng dụng AI, đặc biệt là về khía cạnh suy luận và Tinh chỉnh . Mặc dù các mô hình này có thể hoạt động kém hơn một chút so với các mô hình độc quyền ở một số điểm chuẩn, nhưng hiệu suất của chúng đủ tốt để xử lý hầu hết các trường hợp sử dụng thương mại. Do đó, với sự phổ biến của các mô hình trọng số nguồn mở, nhu cầu suy luận và tinh chỉnh của thị trường ngày càng tăng nhanh.

Mô hình trọng lượng nguồn mở cũng có ba ưu điểm chính:

Đầu tiên, nguồn mở mô hình có nhiều tính linh hoạt cao cho phép người dùng tinh chỉnh mô hình theo các trường hoặc nhiệm vụ cụ thể để thích ứng tốt hơn với các kịch bản ứng dụng khác nhau. Thứ hai, mô hình nguồn mở mang lại độ tin cậy vì trọng số của mô hình sẽ không được cập nhật mà không cần thông báo như một số mô hình độc quyền, tránh được một số vấn đề phát triển do cập nhật gây ra và tăng sự tin tưởng của người dùng vào mô hình. Cuối cùng, nó cũng đảm bảo tính bảo mật và quyền riêng tư, đồng thời doanh nghiệp có thể đảm bảo rằng lời nhắc và dữ liệu khách hàng của họ không bị rò rỉ thông qua điểm cuối API của bên thứ ba, giảm rủi ro về quyền riêng tư dữ liệu. Chính những lợi thế này đã thúc đẩy sự tăng trưởng liên tục và áp dụng rộng rãi các mô hình nguồn mở, đặc biệt là cho suy luận và tinh chỉnh.

Nhu cầu về người tạo mô hình vừa và nhỏ đang thay đổi

Nhỏ và vừa Người tạo mô hình cỡ lớn là những người không có Doanh nghiệp hoặc công ty khởi nghiệp có khả năng hoặc có kế hoạch đào tạo các mô hình cơ bản lớn (như mô hình tham số 70B) từ đầu. Với sự gia tăng của các mô hình nguồn mở, nhiều công ty đã nhận ra rằng việc tinh chỉnh các mô hình nguồn mở hiện có sẽ hiệu quả hơn về mặt chi phí so với việc đào tạo một mô hình mới từ đầu. Kết quả là ngày càng có nhiều công ty lựa chọn tinh chỉnh mô hình của mình thay vì tự đào tạo họ. Điều này làm giảm đáng kể nhu cầu về tài nguyên máy tính như H100.

Tinh chỉnh rẻ hơn nhiều so với đào tạo từ đầu. Việc tinh chỉnh mô hình hiện có đòi hỏi ít tài nguyên tính toán hơn nhiều so với việc đào tạo mô hình cơ sở từ đầu. Việc đào tạo một mô hình cơ sở lớn thường yêu cầu 16 nút H100 trở lên, trong khi việc tinh chỉnh thường chỉ cần 1 đến 4 nút. Sự thay đổi ngành này làm giảm nhu cầu về các cụm quy mô lớn cho các công ty vừa và nhỏ, trực tiếp giảm sự phụ thuộc vào sức mạnh tính toán H100.

Ngoài ra, khoản đầu tư vào việc tạo mô hình cơ sở cũng giảm đi. Vào năm 2023, nhiều công ty vừa và nhỏ cố gắng tạo ra các mô hình cơ sở mới, nhưng ngày nay hầu như sẽ không có mô hình cơ sở mới nào trừ khi họ có thể mang đến những đổi mới (như kiến trúc tốt hơn hoặc hỗ trợ hàng trăm ngôn ngữ) tạo dự án. Điều này là do đã có sẵn các mô hình nguồn mở đủ mạnh trên thị trường, chẳng hạn như Llama 3, khiến các công ty nhỏ gặp khó khăn trong việc biện minh cho việc tạo ra các mô hình mới. Sự quan tâm và tài trợ của nhà đầu tư cũng chuyển sang hướng tinh chỉnh thay vì đào tạo các mô hình từ đầu, giúp giảm hơn nữa nhu cầu về nguồn lực H100.

Cuối cùng, việc dư thừa dung lượng của các nút dự trữ cũng là một vấn đề. Nhiều công ty đã đặt trước tài nguyên H100 dài hạn trong thời kỳ đỉnh cao năm 2023, nhưng khi chuyển sang tinh chỉnh, họ nhận thấy rằng các nút dành riêng này không còn cần thiết nữa và một số phần cứng thậm chí đã lỗi thời. Các nút H100 không được sử dụng này hiện đang được bán lại hoặc cho thuê, làm tăng thêm nguồn cung trên thị trường và dẫn đến tình trạng dư cung tài nguyên H100.

Nhìn chung, với sự phổ biến của việc tinh chỉnh mô hình, việc giảm việc tạo mô hình cơ bản vừa và nhỏ cũng như sự dư thừa của các nút dành riêng, thị trường H100 nhu cầu đã giảm đáng kể, và nguồn cung đã vượt quá nhu cầu tình hình ngày càng căng thẳng.

Các yếu tố khác dẫn đến nguồn cung tăng và nhu cầu về sức mạnh tính toán GPU giảm

Người sáng tạo mô hình lớn Thoát khỏi nền tảng đám mây nguồn mở

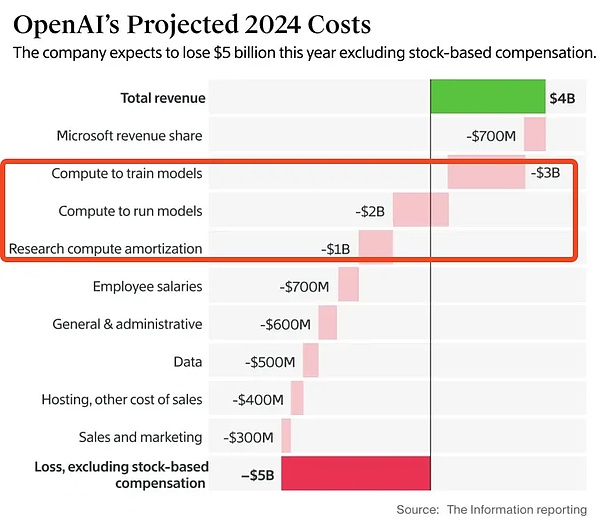

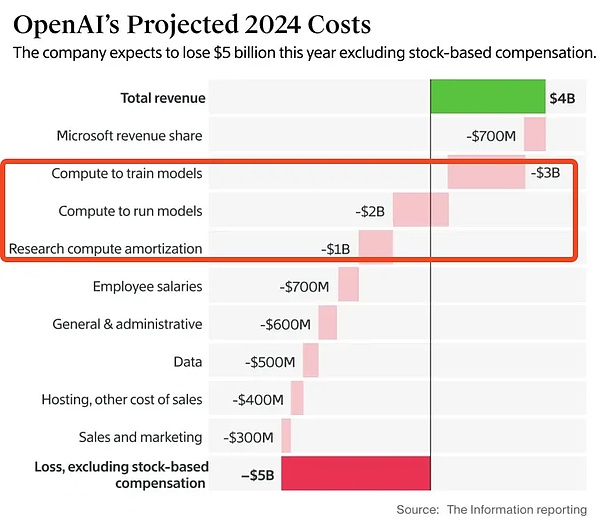

Lý do khiến những người sáng tạo mô hình AI quy mô lớn như Facebook, X.AI và OpenAI đang dần chuyển từ đám mây công cộng nền tảng cho các cụm máy tính riêng tự xây dựng. Đầu tiên, các tài nguyên đám mây công cộng hiện có (chẳng hạn như cụm 1.000 nút) không còn đáp ứng được nhu cầu đào tạo các mô hình lớn hơn. Thứ hai, từ góc độ tài chính, việc xây dựng cụm của riêng bạn sẽ có lợi hơn, vì việc mua các tài sản như trung tâm dữ liệu và máy chủ có thể làm tăng giá trị của công ty, trong khi việc thuê đám mây công cộng chỉ là một khoản chi phí và không thể làm tăng tài sản. Ngoài ra, các công ty này có đủ nguồn lực và đội ngũ chuyên nghiệp để thậm chí mua lại các công ty trung tâm dữ liệu nhỏ để giúp họ xây dựng và quản lý các hệ thống này. Vì vậy, họ không còn phụ thuộc vào đám mây công cộng nữa. Khi các công ty này rời bỏ nền tảng đám mây công cộng, nhu cầu về tài nguyên máy tính của thị trường sẽ giảm, điều này có thể khiến các tài nguyên không được sử dụng quay trở lại thị trường và tăng nguồn cung.

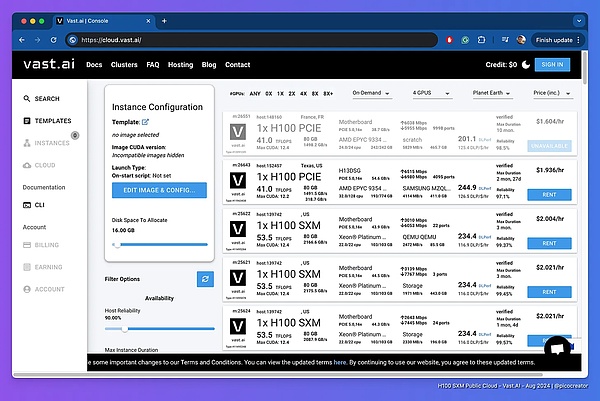

Vast.ai về cơ bản là một hệ thống thị trường tự do, nơi các nhà cung cấp từ khắp nơi trên thế giới cạnh tranh với nhau

GPU H100 nhàn rỗi và bị trì hoãn trực tuyến cùng một lúc

Vì GPU H100 nhàn rỗi và bị trì hoãn trực tuyến cùng lúc nên nguồn cung thị trường tăng lên, dẫn đến giá giảm. Các nền tảng như Vast.ai hoạt động theo mô hình thị trường tự do, nơi các nhà cung cấp toàn cầu cạnh tranh với nhau về giá cả. Vào năm 2023, do lô hàng H100 bị chậm trễ, nhiều tài nguyên không thể đưa vào hoạt động kịp thời và giờ đây, những tài nguyên H100 bị trì hoãn này đang bắt đầu được đưa vào thị trường, cùng với các thiết bị H200 và B200 mới, cũng như các tài nguyên máy tính nhàn rỗi dành cho các công ty khởi nghiệp và doanh nghiệp. . Chủ sở hữu của các cụm vừa và nhỏ thường có 8 đến 64 nút, nhưng do mức độ sử dụng thấp và cạn kiệt quỹ nên mục tiêu của họ là bù đắp chi phí càng nhanh càng tốt bằng cách cho thuê tài nguyên với giá rẻ. Để đạt được mục đích này, họ chọn cách cạnh tranh giành khách hàng thông qua lãi suất cố định, hệ thống đấu giá hoặc định giá thị trường tự do, đặc biệt là các mô hình đấu giá và thị trường tự do, khiến các nhà cung cấp phải cạnh tranh để hạ giá nhằm đảm bảo rằng các nguồn lực được thuê, cuối cùng dẫn đến thiệt hại đáng kể. toàn thị trường giảm giá.

Các lựa chọn thay thế GPU rẻ hơn

Một yếu tố quan trọng khác là, Một khi chi phí tính toán vượt quá ngân sách của bạn, có nhiều lựa chọn thay thế cho cơ sở hạ tầng suy luận AI, đặc biệt nếu bạn đang chạy các mô hình nhỏ hơn. Không cần phải trả thêm tiền khi sử dụng Infiniband H100.

Phân khúc thị trường Nvidia

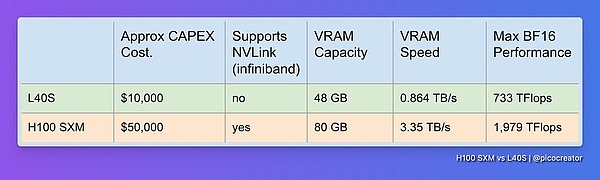

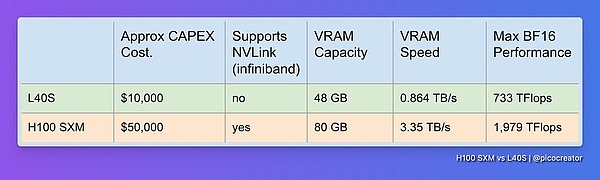

Các lựa chọn thay thế rẻ hơn cho GPU H100 cho các tác vụ suy luận AI xuất hiện, điều này sẽ ảnh hưởng trực tiếp đến nhu cầu thị trường đối với H100. Đầu tiên, mặc dù H100 rất giỏi trong việc đào tạo và tinh chỉnh các mô hình AI, nhưng trong lĩnh vực suy luận (tức là các mô hình đang chạy), nhiều GPU rẻ hơn sẽ đủ dùng, đặc biệt là đối với các mô hình nhỏ hơn. Vì các tác vụ suy luận không yêu cầu các tính năng cao cấp của H100, chẳng hạn như mạng Infiniband, nên người dùng có thể tiết kiệm tiền bằng cách chọn các giải pháp thay thế tiết kiệm hơn.

Bản thân Nvidia cũng cung cấp các sản phẩm thay thế trên thị trường suy luận, chẳng hạn như L40S, một GPU được sử dụng riêng cho suy luận và hiệu suất của nó gấp khoảng ba lần so với GPU H100 Một nhưng giá chỉ bằng 1/5. Mặc dù L40S không hiệu quả bằng H100 trong đào tạo nhiều nút, nhưng nó đủ mạnh để suy luận một nút và tinh chỉnh các cụm nhỏ, cung cấp cho người dùng sự lựa chọn hiệu quả hơn về mặt chi phí.

Hồ sơ hiệu suất cụm Infiniband H100 (tháng 8 năm 2024)

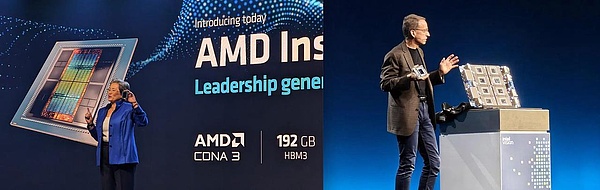

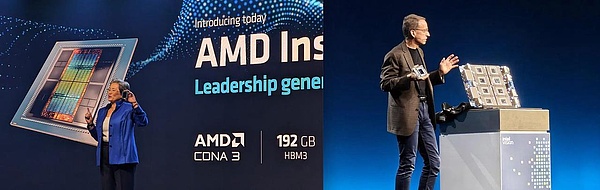

Các nhà cung cấp thay thế AMD và Intel

< p style="text-align: left;">Ngoài ra, AMD và Intel cũng đã tung ra các GPU có giá thấp hơn, chẳng hạn như MX300 của AMD và Gaudi 3 của Intel. Những GPU này hoạt động tốt trong các tác vụ suy luận và nút đơn, rẻ hơn H100 và có nhiều bộ nhớ cũng như sức mạnh tính toán hơn. Mặc dù chúng chưa được xác thực đầy đủ trong quá trình đào tạo cụm nhiều nút lớn nhưng chúng đã đủ trưởng thành trong các nhiệm vụ suy luận để trở thành một giải pháp thay thế mạnh mẽ cho H100.

Những GPU rẻ hơn này đã được chứng minh là có khả năng xử lý hầu hết các tác vụ suy luận, đặc biệt là các tác vụ suy luận và tinh chỉnh trên các kiến trúc mô hình phổ biến như LLaMA 3. Do đó, người dùng có thể lựa chọn những GPU thay thế này để giảm chi phí sau khi giải quyết được vấn đề tương thích. Tóm lại, các lựa chọn thay thế này trong miền suy luận đang dần thay thế H100, đặc biệt là trong các nhiệm vụ tinh chỉnh và suy luận quy mô nhỏ, điều này càng làm giảm nhu cầu về H100.

Việc sử dụng GPU trong trường Web3 đã giảm

Do những thay đổi trong thị trường tiền điện tử, việc sử dụng GPU trong khai thác tiền điện tử đã giảm, và một số lượng lớn GPU đã có mặt trên thị trường đám mây. Mặc dù các GPU này không có khả năng thực hiện các tác vụ đào tạo AI phức tạp do hạn chế về phần cứng, nhưng chúng hoạt động tốt trong các công việc suy luận AI đơn giản hơn, đặc biệt đối với người dùng có ngân sách hạn chế, khi xử lý các mô hình nhỏ hơn (chẳng hạn như thông số GPU dưới 10B trở thành một chi phí thấp). lựa chọn hiệu quả. Được tối ưu hóa, những GPU này có thể chạy cả những mô hình lớn với chi phí thấp hơn so với sử dụng nút H100.

Sau bong bóng cho thuê điện toán AI, thị trường hiện nay như thế nào?

Các vấn đề hiện đang gặp phải: Cụm H100 trên nền tảng đám mây công cộng mới gia nhập thị trường muộn và có thể không mang lại lợi nhuận, đồng thời một số nhà đầu tư có thể bị lỗ nặng.

Những thách thức về lợi nhuận mà các cụm đám mây công cộng H100 mới gia nhập thị trường phải đối mặt. Nếu giá thuê được đặt quá thấp (dưới 2,25 USD) thì có thể không trang trải được chi phí vận hành, dẫn đến thua lỗ; nếu đặt quá cao (3 USD trở lên), có thể mất khách hàng, dẫn đến công suất nhàn rỗi. Ngoài ra, các cụm tham gia thị trường muộn hơn gặp khó khăn trong việc thu hồi chi phí do bỏ lỡ mức giá cao ban đầu ($4/giờ), đồng thời nhà đầu tư phải đối mặt với nguy cơ không kiếm được lợi nhuận. Điều này khiến cho việc đầu tư vào các cụm trở nên rất khó khăn và thậm chí có thể gây thiệt hại đáng kể cho các nhà đầu tư.

Tình hình lợi nhuận của những người tham gia sớm: Những người sáng tạo mô hình vừa hoặc lớn ký hợp đồng thuê dài hạn sớm đã thu hồi được chi phí và đạt được lợi nhuận

Người sáng tạo mô hình quy mô vừa và lớn đã nhận được giá trị thông qua hợp đồng thuê dài hạn tài nguyên máy tính H100, chi phí được thanh toán tại thời điểm cấp vốn. Trong khi một số tài nguyên máy tính không được sử dụng đầy đủ, các công ty này đang khai thác giá trị từ các cụm này thông qua thị trường tài trợ cho hoạt động đào tạo mô hình hiện tại và tương lai. Ngay cả khi có những tài nguyên không được sử dụng, họ có thể kiếm thêm thu nhập thông qua việc bán lại hoặc cho thuê, điều này làm giảm giá thị trường, giảm tác động tiêu cực và nhìn chung có tác động tích cực đến hệ sinh thái.

Sau khi bong bóng vỡ: H100 giá thấp có thể đẩy nhanh làn sóng áp dụng AI nguồn mở

Sự xuất hiện của GPU H100 giá rẻ sẽ thúc đẩy sự phát triển của AI nguồn mở. Khi giá H100 giảm, các nhà phát triển và người có sở thích AI sẽ có giá cả phải chăng hơn để chạy và tinh chỉnh các mô hình trọng lượng nguồn mở, cho phép áp dụng rộng rãi hơn các mô hình này. Nếu các mô hình nguồn đóng (như GPT5++) không đạt được những đột phá lớn về công nghệ trong tương lai, khoảng cách giữa mô hình nguồn mở và mô hình nguồn đóng sẽ được thu hẹp, thúc đẩy sự phát triển của các ứng dụng AI. Khi chi phí suy luận và tinh chỉnh AI giảm, nó có thể kích hoạt một làn sóng ứng dụng AI mới và đẩy nhanh tiến độ chung của thị trường.

Kết luận: Đừng mua một chiếc H100 mới tinh

Nếu bạn đầu tư vào một thương hiệu GPU H100 mới hiện có khả năng bị mất. Tuy nhiên, có thể chỉ hợp lý khi đầu tư trong những trường hợp đặc biệt, chẳng hạn như khi dự án có thể mua H100 giảm giá, chi phí điện rẻ hoặc khi các sản phẩm AI của nó đủ sức cạnh tranh trên thị trường. Nếu bạn đang cân nhắc đầu tư, bạn nên bỏ tiền vào các lĩnh vực khác hoặc thị trường chứng khoán để có tỷ suất lợi nhuận tốt hơn.

JinseFinance

JinseFinance