머스크의 2024년 연말 요약: 그가 세운 기록은 무엇인가요?

2024년, 머스크는 사실상 로켓을 타고 있습니다. 첨단 기술의 혁신, 회사 주가 급등, 정치권 진출, 개인 재산의 급증 등 그 누구도 그의 성공을 따라잡을 수 없습니다.

JinseFinance

JinseFinance

출처: 새로운 뉴인

5월 15일 새벽, 구글의 I/O 개발자 회의가 공식적으로 열렸는데요, 2시간 동안 진행된 회의 내용을 요약하면 다음과 같습니다:

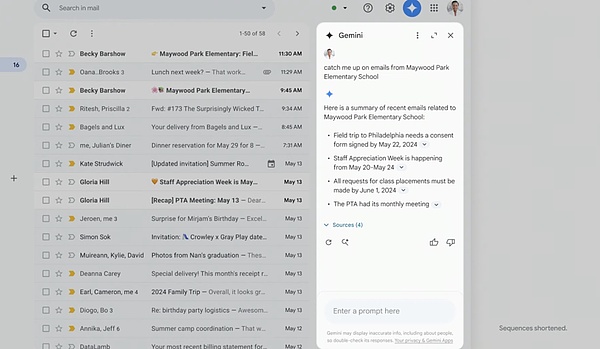

Gmail 사용자는 Gemini AI 기술을 사용하여 이메일을 검색, 요약, 초안 작성할 수 있게 됩니다. 또한 받은 편지함 검색, 영수증 찾기, 온라인 양식 작성 등 전자상거래 반품 지원과 같은 보다 복잡한 작업을 수행하기 위해 이메일을 처리할 수 있습니다.

또 다른 업그레이드 사항은 Gemini가 이전보다 더 긴 문서, 코드 베이스, 비디오 및 오디오 녹음을 분석할 수 있게 되었다는 점입니다. 구글의 현재 주력 모델인 Gemini 1.5 Pro의 새 버전이 비공개로 미리 공개되면서 최대 200만 개의 토큰을 저장할 수 있다고 밝혔습니다. 이는 이전보다 두 배 많은 용량으로, 새로운 Gemini 1.5 Pro는 상용 모델 중 가장 큰 입력을 지원합니다.

이미지 src="https://img.jinse.cn/7225340_image3.png">

고사양을 요구하지 않는 애플리케이션을 위해 Google은 Gemini 1.5 Pro의 "개선된" 버전인 Gemini 1.5 Flash의 공개 프리뷰를 출시했습니다. "Flash는 최대 2백만 토큰의 컨텍스트 창을 지원하며 Gemini 1.5 Pro와 마찬가지로 멀티 모달입니다. Flash는 최대 2백만 개의 토큰 컨텍스트 창을 지원하며, Gemini 1.5 Pro와 마찬가지로 멀티 모달을 지원하므로 텍스트뿐만 아니라 오디오, 비디오, 이미지도 분석할 수 있습니다.

또한 150개 이상의 국가와 35개 이상의 언어를 사용하는 Gemini 고급 사용자는 Gemini 1.5 Pro의 더 큰 컨텍스트를 활용하여 챗봇이 최대 1,500페이지에 달하는 긴 문서를 분석, 요약하고 질문에 답변할 수 있습니다.

이미지 src="https://img.jinse.cn/7225341_image3.png">

Gemini 고급 사용자는 지금 바로 Gemini 1.5 Pro와 상호작용을 시작할 수 있으며, Google 드라이브에서 문서를 가져오거나 에서 문서를 가져오거나 모바일 장치에서 직접 문서를 업로드할 수도 있습니다.

향후 몇 달에 걸쳐 Gemini Advanced에는 프롬프트에 따라 맞춤형 여행 일정을 만들 수 있는 새로운 '계획 환경'이 추가될 예정입니다. 항공편 시간(사용자의 Gmail 받은 편지함에 있는 이메일), 식사 선호도, 지역 명소 정보(Google 검색 및 지도 데이터), 명소 간 거리 등의 요소를 고려하여 Gemini는 변경 사항을 반영하는 자동 업데이트 여정을 생성합니다.

조만간 Gemini 고급 사용자는 Google의 Gemini 모델로 구동되는 맞춤형 챗봇인 Gems를 만들 수 있게 될 것입니다. OpenAI의 GPT와 마찬가지로 Gems는 자연어 설명(예: "당신은 나의 러닝 코치입니다. 매일 달리기 계획을 알려줘"와 같은 자연어 설명을 생성하여 다른 사람과 공유하거나 비공개로 유지할 수 있습니다.

이미지 src="https://img.jinse.cn/7225342_image3.png">

조만간 Gems와 Gemini는 Google 캘린더, 작업, Keep, YouTube 뮤직 등 Google 서비스와의 확장된 통합 기능을 활용하여 다양한 노동력 절감 작업을 수행할 수 있습니다.

구글은 제미니에서 제미니 라이브라는 새로운 경험을 미리 선보였습니다.

Google은 사용자가 스마트폰에서 제미니와 '심층적인' 음성 채팅을 할 수 있는 제미니 라이브라는 새로운 경험을 제미니에서 미리 선보였습니다.

사용자는 챗봇이 대화하는 동안 제미니를 중단하고 명확한 질문을 할 수 있으며, 제미니는 사용자의 음성 패턴에 실시간으로 적응합니다.

제미니는 스마트폰의 카메라로 찍은 사진이나 동영상을 통해 사용자의 주변 환경을 보고 반응할 수 있습니다.

구글은 제너레이티브 AI의 새로운 기술을 활용하여 오류가 적은 우수한 이미지 분석을 제공하고, 이를 향상된 음성 엔진과 결합하여 보다 일관되고 감정 표현이 풍부하며 사실적인 다원 대화를 제공한다고 설명합니다.

어떤 면에서 제미니 라이브는 이미지와 동영상을 분석하는 구글의 오랜 컴퓨터 비전 플랫폼인 구글 렌즈와 휴대폰, 스마트 스피커, TV를 아우르는 구글의 AI 기반 음성 생성 및 인식 가상 비서인 구글 어시스턴트의 진화된 버전이라고 할 수 있습니다.

딥마인드의 수석 과학자인 오리올 빈얄스는 매우 강력한 멀티모달 기능과 긴 컨텍스트를 갖춘 실시간 음성 인터페이스라고 말합니다.

라이브의 기술 혁신은 부분적으로는 실시간 멀티모달 이해를 가능하게 하는 AI 기반 앱과 인텔리전스를 개발하기 위한 딥마인드 내 새로운 이니셔티브인 프로젝트 아스트라에서 비롯되었습니다.

데미스 하사비스 딥마인드 CEO는 구글은 항상 일상 생활에서 유용한 범용 인텔리전스를 구축하고자 했으며, 우리가 하는 일을 보고 들을 수 있고, 환경을 더 잘 이해하고, 대화에서 빠르게 반응하여 상호작용의 속도와 품질을 더 자연스럽게 느낄 수 있는 에이전트를 상상해 왔다고 말했습니다.

올해 말에 출시될 예정인 제미니 라이브는 사용자가 위치한 동네나 손상된 자전거의 부품 이름과 같이 스마트폰 카메라 시야에 있거나 가장 가까운 사물에 대한 질문에 답할 수 있다고 합니다. 컴퓨터 코드의 일부를 가리키면 Live는 해당 코드가 무엇을 하는지 설명할 수 있습니다. 또는 안경이 어디에 있는지 물어보면 Live는 마지막으로 안경을 '본' 위치를 알려줄 수 있습니다.

이미지 src="https://img.jinse.cn/7225344_image3.png">

Live는 또한 일종의 가상 코치 역할을 하도록 설계되어 사용자가 활동을 리허설하고 아이디어를 브레인스토밍하는 등의 작업을 할 수 있도록 도와줍니다. 예를 들어, Live는 다가오는 취업 또는 인턴십 면접에서 강조해야 할 기술을 제안하거나 대중 연설에 대한 조언을 제공할 수 있습니다.

새로운 ChatGPT와 Gemini Live의 가장 큰 차이점은 Gemini Live는 무료가 아니라는 점입니다. 라이브가 출시되면 월 20달러의 Google One AI 프리미엄 요금제로 보호되는 Gemini의 더 정교한 버전인 Gemini Advanced의 독점 버전이 될 것입니다.

구글은 또한 가장 작은 AI 모델을 구축하는 Chrome 126을 시작합니다. Chrome 데스크톱 클라이언트에 직접 내장된 Gemini Nano. 구글은 이를 통해 개발자가 기기에서 이 모델을 사용하여 자체 AI 기능을 지원할 수 있을 것이라고 말합니다. 예를 들어, Google은 이 새로운 기능을 사용하여 Gmail의 기존 '도움말 작성' 도구와 같은 기능을 지원할 계획입니다.

구글의 Chrome 제품 관리 디렉터인 존 달케는 다른 브라우저 공급업체와도 브라우저에서 이 기능 또는 유사한 기능을 사용할 수 있도록 협의 중이라고 밝혔습니다.

구글의 Chrome 제품 관리 디렉터인 존 달케는 다른 브라우저 공급업체와도 브라우저에서 이 기능 또는 유사한 기능을 사용할 수 있도록 협의 중이라고 밝혔습니다.

Google의 Android용 Gemini는 Google 어시스턴트를 대체하는 '인공지능'으로, 곧 Android 모바일 운영체제와 통합할 수 있고 Google 앱의 심층 통합 기능을 활용할 수 있습니다.

사용자는 AI가 생성한 이미지를 Gmail, Google 메시지 및 기타 앱으로 직접 드래그 앤 드롭할 수 있게 될 것입니다.

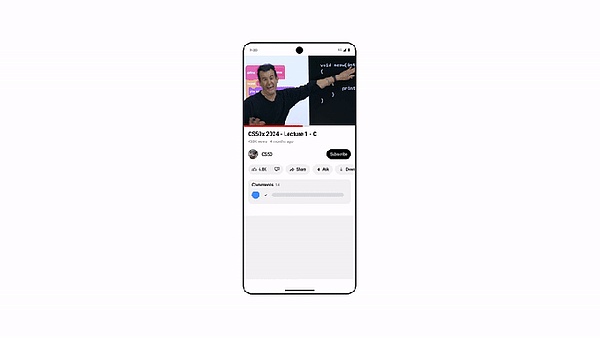

구글은 동시에 유튜브 사용자가 '이 동영상에 대해 질문'을 클릭하여 해당 유튜브 동영상에서 특정 정보를 찾을 수 있게 될 것이라고 밝혔습니다. 동영상을 클릭하여 특정 정보를 찾을 수 있습니다.

업그레이드된 Gemini Advanced를 구입한 사용자는 모든 페이지를 읽지 않고도 문서에서 답변을 얻을 수 있는 '이 PDF에 대해 물어보세요' 옵션도 사용할 수 있습니다. 2TB의 저장 용량과 기타 Google One 혜택도 제공됩니다.

구글은 Android용 Gemini의 최신 기능이 앞으로 수개월 내에 수억 대의 지원 기기에 제공될 예정이라고 밝혔습니다. 시간이 지남에 따라 Gemini는 화면에 표시되는 내용과 관련된 추가 제안을 제공하도록 발전할 것입니다.

그 동안 Android 디바이스의 기본 모델인 Gemini Nano는 멀티 모달리티를 포함하도록 업그레이드될 예정입니다. 즉, 텍스트 입력은 물론 시각, 음성, 음성 언어 등 다른 정보 처리 방식도 처리할 수 있게 됩니다.

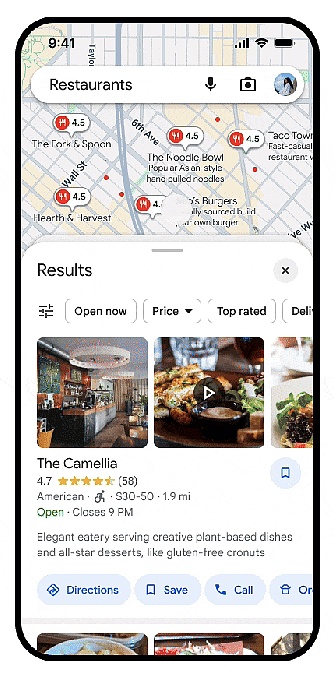

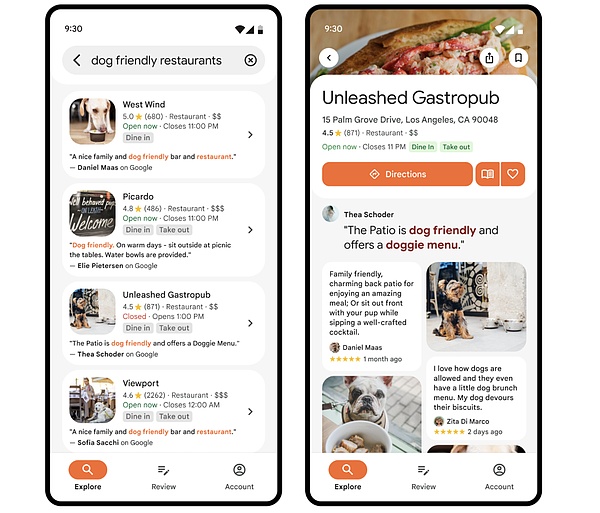

장소 API를 시작으로 개발자가 사용할 수 있는 Gemini 모델 기능이 Google 지도 플랫폼에 제공될 예정입니다. 개발자는 앱과 웹사이트에 생성된 위치 및 지역의 AI 요약을 표시할 수 있습니다. 이러한 요약은 3억 명 이상의 Google 지도 커뮤니티 기여자가 제공한 인사이트에 대한 Gemini의 분석을 기반으로 만들어집니다.

이 요약은 3억 명 이상의 Google 지도 커뮤니티 기여자가 제공한 인사이트에 대한 Gemini의 분석을 기반으로 만들어졌습니다. 이 새로운 기능을 통해 개발자는 더 이상 사용자 지정 위치 설명을 직접 작성할 필요가 없습니다.

예를 들어 개발자가 레스토랑 예약 앱을 만든 경우, 이 새로운 기능은 사용자가 자신에게 가장 적합한 레스토랑을 이해하는 데 도움이 됩니다. 사용자가 앱에서 레스토랑을 검색하면 레스토랑 스페셜, 해피아워 특가, 레스토랑 분위기 등 가장 중요한 정보를 모두 빠르게 확인할 수 있습니다.

새로운 요약 기능은 레스토랑, 상점, 슈퍼마켓, 공원, 영화관 등 다양한 유형의 장소에서 작동합니다. 사용자가 개발자의 제품에서 장소를 검색하면 개발자는 이제 검색과 관련된 리뷰와 사진을 표시할 수 있습니다.

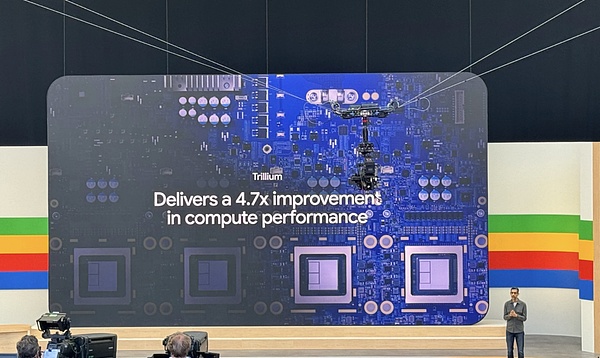

Google은 차세대 기술을 공개했습니다. - 정확히 6세대 TPU AI 칩을 공개했습니다. 트릴리움이라고 불리는 이 칩은 올해 말 출시될 예정입니다. 기억하시겠지만, 차세대 TPU를 발표하는 것은 I/O 컨퍼런스에서 전통이 되었지만, 이 칩은 올해 말에나 출시됩니다.

>

이 새로운 TPU는 5세대에 비해 칩당 4.7배 더 뛰어난 컴퓨팅 성능을 제공합니다. 트릴리움에는 3세대 스파스코어가 탑재되어 있으며, 구글은 이를 '고급 랭킹을 처리하는 새로운 기술'이라고 설명합니다. 트릴리움에는 3세대 스파스코어가 탑재되어 있는데, 구글은 이를 '고급 랭킹 및 추천 워크로드에서 흔히 발생하는 매우 큰 임베딩을 처리하기 위한 전용 가속기'라고 설명합니다.

피차이는 이 새로운 칩이 지금까지 구글의 "가장 에너지 효율적인" TPU라고 설명하며, 이는 AI 칩에 대한 수요가 기하급수적으로 증가함에 따라 특히 중요하다고 강조했습니다. 그는 ML 컴퓨팅에 대한 업계의 수요가 지난 6년 동안 100만 배, 즉 매년 약 10배씩 증가했으며, 이러한 칩의 전력 요구 사항을 줄이기 위한 투자 없이는 지속 가능하지 않다고 말했습니다. Google은 새로운 TPU가 5세대 칩보다 에너지 효율이 67% 더 높다고 약속합니다.

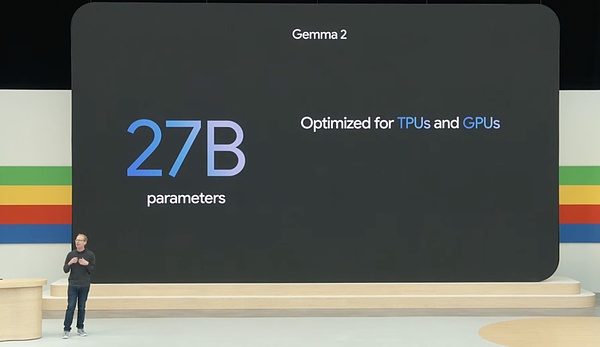

또한 Google은 Gemma 2에 270억 개의 새로운 파라미터 모델을 추가하고 있습니다. 차세대 구글 젬마 모델은 6월에 출시될 예정입니다. Google은 이 크기가 차세대 GPU에서 실행되고 단일 TPU 호스트와 버텍스 AI에서 효율적으로 실행되도록 Nvidia에 의해 최적화되었다고 말합니다.

구글이 이매진 모델의 최신 제품인 이매진3를 공개했습니다. 데미스 하사비스 딥마인드 CEO는 이매진3가 이전 버전인 이매진2에 비해 이미지로 번역된 텍스트 단서를 더 정확하게 이해할 수 있다고 말했습니다. 이전 모델보다 더 창의적이고 미묘한 차이를 보인다고 말했습니다.

구글이 이매진 모델의 최신 제품인 이매진3를 공개했습니다. 데미스 하사비스 딥마인드 CEO는 이매진3가 이전 버전인 이매진2에 비해 이미지로 번역된 텍스트 단서를 더 정확하게 이해할 수 있다고 말했습니다. 이전 모델보다 더 창의적이고 미묘한 차이를 보인다고 말했습니다.

위조 가능성에 대한 우려를 완화하기 위해 구글은 Imagen 3가 딥마인드에서 개발한 보이지 않는 암호화 워터마크를 미디어에 적용하는 방법인 SynthID를 사용할 것이라고 밝혔습니다.

구글의 ImageFX 도구는 Imagen 3의 비공개 미리보기를 위해 등록할 수 있으며, 구글은 이 모델이 구글의 기업용 생성 AI 개발 플랫폼인 Vertex AI를 사용하는 개발자와 기업 고객에게 "곧" 제공될 예정이라고 밝혔습니다.

구글은 OpenAI의 소라 위드 베오를 겨냥하고 있습니다. 텍스트 프롬프트를 기반으로 약 1분 길이의 1080p 비디오 클립을 생성하는 AI 모델로, 풍경과 타임랩스 영상 등 다양한 시각적 및 영화적 스타일을 캡처하고 생성된 영상을 편집 및 조정할 수 있습니다.

또한 지난 4월에 공개된 구글의 이미지 생성 모델인 Imagen 2 제품군을 사용하여 반복되는 비디오 클립을 생성하는 동영상 생성 분야의 첫 번째 상용 작업을 기반으로 합니다.

데미스 하사비스는 구글이 스토리보드와 긴 장면 생성 등의 기능을 연구하고 있으며, 구글은 동영상 분야에서 놀라운 진전을 이뤘다고 말했습니다.

Veo는 수많은 영상으로 학습됩니다. 어떤 형태의 데이터 예시를 계속 입력하면 모델이 데이터에서 새로운 데이터(Veo의 경우 동영상)를 생성할 수 있는 패턴을 찾아내는 것이 생성형 AI 모델의 작동 방식입니다.

그러나 Google은 Donald Glover(일명 차일디쉬 감비노)와 그가 소속된 크리에이티브 에이전시 길가

>

Google은 LearnLM을 도입했습니다. 이는 학습을 위해 "미세 조정"된 새로운 생성형 AI 모델 제품군입니다. 이는 구글의 딥마인드 AI 연구 부서와 구글 리서치 간의 협업으로 이루어졌습니다. Google은 LearnLM 모델이 다양한 과목에서 학생들을 "대화식으로" 지도하도록 설계되었다고 말합니다.

LearnLM은 이미 Google의 여러 플랫폼에서 사용할 수 있으며, Google 클래스 룸에서 파일럿 프로그램을 통해 LearnLM이 사용되고 있습니다. Google은 교사가 새로운 아이디어, 콘텐츠 및 활동을 발견하거나 특정 학생 그룹의 요구에 맞는 자료를 찾는 데 LearnLM이 도움이 될 수 있다고 말합니다.

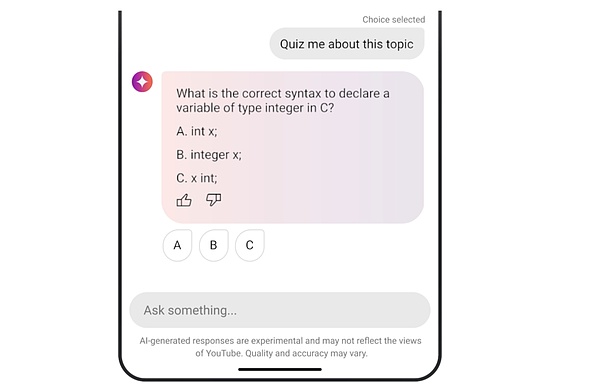

유튜브에 새로 추가된 것은 'AI' 생성 퀴즈입니다. 이 새로운 대화형 AI 도구는 사용자가 교육 동영상을 시청하는 동안 비유적으로 "손을 들게" 합니다. 시청자는 명확한 질문을 하거나, 유용한 설명을 듣거나, 주제에 대한 퀴즈를 풀 수 있습니다.

강의나 세미나와 같이 긴 교육용 동영상을 시청해야 하는 사용자들이 쉽게 이용할 수 있는 Gemini 모델의 긴 문맥 기능 덕분에 새로운 기능은 미국의 일부 Android 사용자에게 배포되고 있습니다.

구글의 차세대 'AI' 중심 브라우저 기반 개발 환경인 프로젝트 IDX가 현재 공개 베타 버전으로 출시되었습니다.

이미지 src="https://img.jinse.cn/7225361_image3.png">

구글의 부사장 겸 총괄 매니저이자 개발자 X 책임자인 제닌 뱅크스는 AI가 더욱 보편화되면서 이러한 모든 기술을 배포하는 데 따르는 복잡성 때문에 점점 더 어려워지고 있으며, Google은 이 문제를 해결하는 데 도움을 주고자 합니다. 개발자 관계, 이것이 바로 <프로젝트 IDX>를 구축한 이유입니다.

IDX는 앱을 빠르고 쉽게 빌드할 수 있는 멀티플랫폼 개발 환경으로, Next.js, Astro, Flutter, Dart, Angular, Go 등을 위한 사용하기 쉬운 템플릿을 통해 선호하는 프레임워크나 언어를 쉽게 사용할 수 있습니다.

또한 Google은 앱에 지리적 위치 기능을 추가할 수 있도록 IDE에 Google 지도 플랫폼과의 통합을 추가하고, 앱 디버그를 돕기 위해 Chrome 개발자 도구 및 Lighthouse와의 통합을 추가했습니다. 곧 Google은 프런트엔드 및 백엔드 서비스를 실행하기 위한 Google Cloud의 서버리스 플랫폼인 Cloud Run에 앱을 배포하는 기능도 지원할 예정입니다.

개발 환경은 또한 화요일에 베타 버전에서 정식 버전으로 전환되는 Google의 AI 기반 규정 준수 플랫폼인 'Checks'와 통합될 예정입니다. 물론 IDX는 AI 지원 앱을 구축하는 것뿐만 아니라 코딩 과정에서 AI를 사용하는 것을 목표로 합니다.

이를 위해 IDX에는 코드 완성 및 채팅 지원 사이드바 등 현재 표준이 된 여러 기능과 코드 스니펫 강조 기능, 포토샵과 유사한 채우기 생성 기능 등 혁신적인 기능이 포함되어 있습니다.

이를 실현하기 위해 회사의 Gemini 모델은 작동 방식을 바꿉니다. Google의 Gemini 모델에 코드 스니펫 변경을 요청하세요.

제미니는 코드를 제안할 때마다 원본 소스 및 관련 라이선스로 다시 링크합니다. Google이 오픈 소스 Visual Studio의 핵심으로 구축한 프로젝트 IDX. 코드를 핵심으로 하며, 기존 워크플로와 쉽게 통합할 수 있도록 GitHub와도 통합됩니다. 최신 버전의 IDX에서 Google은 모바일 개발자를 위해 IDE에 내장된 iOS 및 Android 시뮬레이터도 추가했습니다.

Google의 검색 책임자인 Liz Reid는 실시간 정보, Google 순위, 긴 컨텍스트 실시간 정보, Google 랭킹, 긴 문맥, 멀티모달 기능을 결합한 맞춤형 Gemini 모델을 구축했습니다.

이미지 src="https://img.jinse.cn/7225363_image3.png">

Google은 검색에 더 많은 'AI'를 추가하여 ChatGPT 및 Perplexity와 같은 경쟁업체에 시장 점유율을 빼앗기고 있다는 우려를 완화하고 있습니다. 경쟁사에 시장 점유율을 빼앗기고 있다는 우려를 완화하고 있습니다.

구글은 미국 사용자들을 대상으로 인공지능 기반 개요를 출시하고 있습니다. 또한 여행 계획과 같은 분야에서 Gemini를 스마트 바디로 활용하는 방안도 모색하고 있습니다.

구글은 특정 검색 결과에 대한 전체 검색 결과 페이지를 구성하는 데 생성형 AI를 사용할 계획입니다. 이는 사용자가 검색하는 주제에 대한 집계된 정보가 포함된 짧은 스니펫을 생성하는 기존의 'AI 개요' 기능을 보완합니다. 구글의 AI 연구소에서 계획한 일정 기간이 지나면 화요일에 'AI 개요' 기능을 완전히 사용할 수 있습니다.

이미지 src="https://img.jinse.cn/7225364_image3.png">

구글은 작년부터 검색 세대 경험(SGE)을 통해 AI 기반 오버뷰를 테스트해 왔습니다. 이번 주부터 미국 내 '수억 명의 사용자'를 대상으로 서비스를 시작했으며, 연말까지 10억 명 이상의 사용자에게 제공한다는 목표를 세우고 있습니다.

또한 구글은 AI 개요 기능을 테스트하는 동안 사람들이 더 다양한 사이트를 클릭하는 것을 관찰했다고 말했습니다. 사용자는 기존 검색으로 충분한 결과를 얻을 수 있는 경우에는 AI 개요를 보지 못하며, 이 기능은 정보가 흩어져 있는 복잡한 쿼리에 더 유용합니다.

이미지 src="https://img.jinse.cn/7225365_image3.png">

Google은 또한 식사나 여행 계획과 같은 업무에 Gemini를 지능형 신체 에이전트로 사용하고자 합니다. 사용자는 "4인 가족을 위한 3일간의 식사 계획"과 같은 검색어를 입력하면 해당 3일 동안의 링크와 레시피를 얻을 수 있습니다.

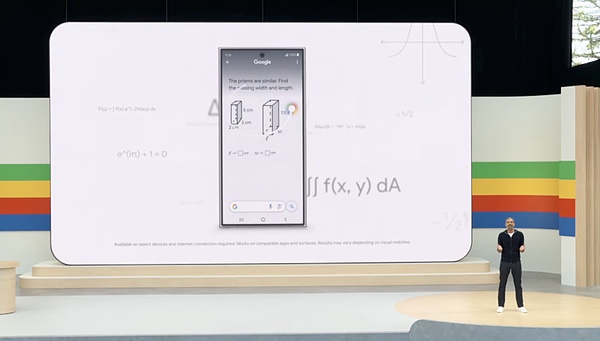

인공지능 기반 '서클 검색 ' 기능은 안드로이드 사용자가 원을 돌리는 등의 제스처로 즉시 답을 얻을 수 있는 기능으로, 이제 더 복잡한 심리 및 수학 앱도 해결할 수 있습니다.

사용자가 휴대전화의 어디에서나 동그라미, 강조 표시, 낙서, 탭 등 다양한 동작을 통해 보다 자연스럽게 Google 검색을 사용할 수 있도록 설계되었습니다.

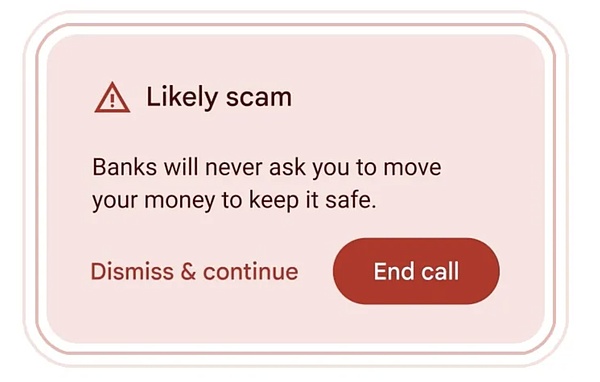

구글은 통화 중 사용자에게 잠재적인 사기 가능성을 경고하는 기능을 미리 선보였습니다. 잠재적인 사기를 조심하도록 경고하는 기능을 미리 선보였습니다.

향후 Android 버전에 탑재될 이 기능은 기기 자체에서 실행되는 Google의 가장 작은 버전의 생성형 AI 서비스인 Gemini Nano를 활용합니다. 이 시스템은 "일반적으로 사기와 연관된 대화 패턴"을 실시간으로 효과적으로 청취합니다.

구글은 '은행 담당자'로 가장하는 사람의 예를 들었습니다. 이 시스템은 또한 비밀번호 요청 및 기프트 카드와 같은 일반적인 사기 수법에 의해 트리거됩니다. 이러한 수법은 사용자의 돈을 빼내는 잘 알려진 방법이지만 전 세계의 많은 사람들이 여전히 이러한 사기에 취약합니다. 이 기능이 활성화되면 사용자에게 불쾌한 캐릭터의 희생양이 될 수 있음을 알리는 알림을 표시합니다.

>

Google 포토는 인공지능(AI)을 기반으로 한 라는 실험적인 기능을 출시하며 AI를 도입하고 있습니다. 올여름 말에 출시되는 이 새로운 기능을 통해 사용자는 사진 콘텐츠 및 기타 메타데이터에 대한 AI의 이해를 활용하는 자연어 쿼리를 사용하여 Google 사진 컬렉션을 검색할 수 있습니다.

이전에는 자연어 처리의 도움으로 사진 속 특정 인물, 장소 또는 사물을 검색할 수 있었지만, 이번 AI 업그레이드를 통해 사용자는 보다 직관적으로 원하는 콘텐츠를 찾고 수동 검색 과정을 줄일 수 있게 됩니다.

파이어베이스 플랫폼에는 개발자들이 보다 쉽게 콘텐츠를 개발할 수 있도록 설계된 파이어베이스 젠키트 이라는 새로운 기능을 추가하여 개발자들이 자바스크립트/타입스크립트를 사용하여 AI 기반 앱을 더 쉽게 구축할 수 있도록 설계되었으며, Go에 대한 지원도 곧 제공될 예정입니다.

파이어베이스 플랫폼에는 개발자들이 보다 쉽게 콘텐츠를 개발할 수 있도록 설계된 파이어베이스 젠키트 이라는 새로운 기능을 추가하여 개발자들이 자바스크립트/타입스크립트를 사용하여 AI 기반 앱을 더 쉽게 구축할 수 있도록 설계되었으며, Go에 대한 지원도 곧 제공될 예정입니다.

개발자가 Apache 2.0 라이선스를 사용하여 신규 및 기존 애플리케이션에 AI를 신속하게 구축할 수 있는 오픈 소스 프레임워크입니다.

또한 Google은 콘텐츠 생성 및 요약, 텍스트 번역 및 이미지 생성 등 여러 가지 표준 GenAI 사용 사례를 포함하여 Genkit의 일부 사용 사례를 강조합니다.

Google Play는 새로운 앱 검색 기능, 새로운 사용자 확보 방법, Play 포인트 업데이트, 새로운 사용자 확보 방법 등으로 세계에서 가장 인기 있는 모바일 앱이 되었습니다. Google Play는 새로운 앱 검색 기능, 사용자를 확보하는 새로운 방법, Play 포인트 업데이트, Google Play SDK 콘솔 및 Play Integrity API와 같은 개발자 도구의 기타 개선 사항으로 주목을 받고 있습니다.

개발자들이 특히 관심을 가질 만한 것은 앱 제작자가 사용자에게 콘텐츠를 전체 화면의 몰입형 환경으로 보여줄 수 있는 방법을 소개하는 '인게이지 SDK'입니다. 하지만 구글은 현재로서는 사용자가 이 화면을 볼 수 없다고 말합니다.

2024년, 머스크는 사실상 로켓을 타고 있습니다. 첨단 기술의 혁신, 회사 주가 급등, 정치권 진출, 개인 재산의 급증 등 그 누구도 그의 성공을 따라잡을 수 없습니다.

JinseFinance

JinseFinance세계에서 가장 영향력 있는 블록체인 행사 중 하나인 블록체인 라이프 2024에서 Gate.io는 주요 스폰서이자 업계의 사고 리더로서 무대에 올랐습니다.

JinseFinance

JinseFinance웹3.0 기업의 16%가 .io를 사용합니다. ccTLD(국가 및 지역 최상위 도메인)는 역사상 5번 삭제되었습니다.

JinseFinance

JinseFinance2024년 암호화폐 시장은 전반적으로 예년에 비해 혁신 스토리가 부족한 가운데 한 해를 시작했으며, 다양한 신기술과 도구가 잇달아 등장했음에도 불구하고 몇몇 핫트랙을 제외하고는 대부분 평범한 흐름을 이어가고 있습니다.

JinseFinance

JinseFinance미국 증권거래위원회, 여러 현물 이더리움 ETF S-1 제출에 대한 유효성 통지서 발행, EU MiCA 법안, 스테이블코인에 규제 부과, 홍콩 금융관리국, 앙상블 프로젝트 샌드박스 출시, 홍콩 스테이블코인 협의 요약 공개 ......

JinseFinance

JinseFinance코리아 블록체인 위크의 공식 행사 중 하나인 게이트아이오가 주최한 2024 리드 아시아 자선 파티가 어제 밤 성황리에 막을 내렸습니다.

JinseFinance

JinseFinance2024년 1분기에 디지털 자산 업계에 영향을 미칠 주요 이벤트에 대한 데이터 기반 검토

JinseFinance

JinseFinanceEthereum Shanghai Upgrade Testnet 활성화, FEVM 출시, Illuvium, NFT 수집용 게임 출시

Coinlive

Coinlive The Block의 리서치 디렉터 Lars의 분석.

Twitter

Twitter Bitcoinist

Bitcoinist