Tác giả: Zhao Jian

Vào ngày 27 tháng 1, hai năm trước, "Jiazi Guannian" đã tham gia một salon với chủ đề video do AI tạo ra. Tại cuộc họp đã có một sự tương tác thú vị: Thế hệ video AI sẽ mở ra "Khoảnh khắc giữa cuộc hành trình" trong bao lâu?

Các lựa chọn trong vòng nửa năm, trong vòng một năm, 1-2 năm hoặc lâu hơn.

Hôm qua, OpenAI đã công bố câu trả lời chính xác: 20 ngày.

OpenAI ngày hôm qua đã phát hành Sora, một mô hình video mới do AI tạo ra. Với những ưu điểm về hiệu suất có thể nhìn thấy bằng mắt thường và thời gian tạo video lên tới 60 giây, theo sau văn bản (GPT-4 ) và hình ảnh (DALL·E 3), nó cũng đã đạt được "dẫn đầu xa" trong lĩnh vực tạo video. Chúng ta đang tiến một bước gần hơn tới AGI (Trí tuệ tổng hợp nhân tạo).

Điều đáng nói là công ty AI ngôi sao Stability AI ban đầu đã phát hành mô hình video mới SVD1.1 vào ngày hôm qua, nhưng do va chạm với Sora nên sự thúc đẩy chính thức của nó Bài viết đã nhanh chóng bị xóa.

Cristóbal Valenzuela, đồng sáng lập và CEO của Runway, một trong những công ty đi đầu trong lĩnh vực tạo video AI, đã tweet: "Trò chơi đã bắt đầu."< /p>

OpenAI cũng đã phát hành một tài liệu kỹ thuật vào ngày hôm qua, nhưng về mặt kiến trúc mô hình và phương pháp đào tạo, nó không đưa ra bất kỳ công nghệ đổi mới cấp độ thiên tài nào mà tối ưu hóa nhiều hơn các lộ trình công nghệ hiện có.

Nhưng giống như ChatGPT, được ra mắt cách đây hơn một năm, bí mật của OpenAI là Luật mở rộng đã được thử nghiệm và kiểm nghiệm - khi mô hình video là đủ " " Big" sẽ tạo ra khả năng trí thông minh xuất hiện.

Vấn đề là hầu hết mọi người đều biết đến "tính thẩm mỹ bạo lực" của việc đào tạo mô hình lớn. Tại sao lần này lại là OpenAI?

1. Bí mật của dữ liệu: từ token đến bản vá

Lộ trình kỹ thuật để tạo video chủ yếu trải qua bốn giai đoạn: mạng tái phát (RNN), mạng đối thủ tổng hợp (GAN), máy biến áp tự hồi quy và mô hình khuếch tán.

Ngày nay, hầu hết các mô hình video hàng đầu đều là mô hình phổ biến, chẳng hạn như Runway, Pika, v.v. Các mô hình tự hồi quy cũng đã trở thành một hướng nghiên cứu phổ biến nhờ khả năng mở rộng và đa phương thức tốt hơn, chẳng hạn như VideoPoet do Google phát hành vào tháng 12 năm 2023.

Sora là mẫu máy biến áp khuếch tán mới. Như có thể thấy từ cái tên, nó kết hợp các đặc điểm kép của mô hình khuếch tán và mô hình tự hồi quy. Kiến trúc máy biến áp khuếch tán được đề xuất vào năm 2023 bởi William Peebles của Đại học California, Berkeley và Saining Xie của Đại học New York.

Làm thế nào để đào tạo mô hình mới này? Trong tài liệu kỹ thuật, OpenAI đề xuất cách sử dụng các bản vá (bản vá trực quan) làm dữ liệu video để huấn luyện các mô hình video, lấy cảm hứng từ token của các mô hình ngôn ngữ lớn. Mã thông báo hợp nhất nhiều chế độ văn bản—mã, toán học và các ngôn ngữ tự nhiên khác nhau một cách tinh tế—trong khi các bản vá hợp nhất hình ảnh và video.

OpenAI đào tạo mạng để giảm tính chiều của dữ liệu trực quan. Mạng này nhận video thô làm đầu vào và xuất ra biểu diễn tiềm ẩn được nén cả về thời gian và không gian. Sora được huấn luyện về không gian tiềm ẩn được nén này và sau đó tạo ra các video. OpenAI cũng đào tạo một mô hình giải mã tương ứng để ánh xạ biểu diễn tiềm ẩn được tạo trở lại không gian pixel.

OpenAI tuyên bố rằng các phương pháp tạo hình ảnh và video trước đây thường thay đổi kích thước, cắt xén hoặc cắt bớt video theo kích thước tiêu chuẩn, làm giảm chất lượng của quá trình tạo video. Ví dụ: video dài 4 giây với độ phân giải 256x256. Sau khi dữ liệu hình ảnh và video được vá, dữ liệu gốc của video và hình ảnh với độ phân giải, thời lượng và tỷ lệ khung hình khác nhau có thể được đào tạo mà không cần nén dữ liệu.

Phương pháp xử lý dữ liệu này mang lại hai lợi thế cho việc đào tạo mô hình:

< strong>Đầu tiên, lấy mẫu linh hoạt. Sora có thể lấy mẫu video màn hình rộng 1920x1080p, video dọc 1080x1920 và mọi thứ ở giữa, tạo nội dung trực tiếp cho các thiết bị khác nhau ở tỷ lệ khung hình gốc của chúng và nhanh chóng tạo nội dung nguyên mẫu ở kích thước thấp hơn. Tất cả đều sử dụng cùng một mô hình.

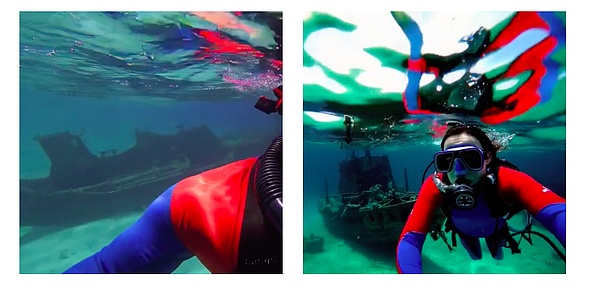

Thứ hai, cải thiện khung hình và bố cục. OpenAI đã phát hiện ra bằng thực nghiệm rằng việc đào tạo về video ở tỷ lệ khung hình gốc sẽ cải thiện bố cục và khung hình. Ví dụ: một mô hình phổ biến cắt tất cả các video đào tạo thành các hình vuông đôi khi tạo ra các video chỉ hiển thị một phần chủ đề. Ngược lại, việc đóng khung video của Sora được cải thiện.

Mô hình được đào tạo trên cây trồng hình vuông (trái), mô hình của Sora (phải)

Ở cấp độ hiểu ngôn ngữ, OpenAI nhận thấy rằng việc đào tạo về phụ đề video có tính mô tả cao sẽ cải thiện độ trung thực của văn bản và chất lượng tổng thể của video.

Để đạt được mục tiêu này, OpenAI đã áp dụng "kỹ thuật tạo lại phụ đề" được giới thiệu trong DALL·E 3 - trước tiên đào tạo mô hình tạo phụ đề A có tính mô tả cao và sau đó sử dụng nó để tạo phụ đề văn bản cho các video trong tập dữ liệu huấn luyện.

Ngoài ra, tương tự như DALL·E 3, OpenAI cũng sử dụng GPT để chuyển lời nhắc ngắn của người dùng thành phụ đề chi tiết dài hơn rồi gửi đến mô hình video. Điều này cho phép Sora tạo ra các video chất lượng cao, làm theo chính xác lời nhắc của người dùng.

Lời nhắc: một người phụ nữ mặc quần jean xanh và áo phông trắng, đang đi dạo thú vị ở Mumbai Ấn Độ trong một lễ hội đầy màu sắc.

Ngoài video tạo văn bản, Sora còn hỗ trợ "video tạo hình ảnh" và "video tạo video".

Lời nhắc: Trong một hội trường lịch sử được trang trí công phu, một làn sóng thủy triều khổng lồ đạt đỉnh và bắt đầu ập vào. Hai vận động viên lướt sóng, nắm bắt khoảnh khắc, khéo léo điều hướng mặt sóng.

Tính năng này cho phép Sora thực hiện nhiều tác vụ chỉnh sửa hình ảnh và video khác nhau, tạo video lặp hoàn hảo, hình ảnh tĩnh động, kéo dài video tiến hoặc lùi theo thời gian, v.v.

2. Bí mật của điện toán: vẫn là "thẩm mỹ của bạo lực"

Trong tài liệu kỹ thuật của Sora, OpenAI không tiết lộ chi tiết kỹ thuật của mô hình (Elon Musk từng chỉ trích OpenAI không còn như dự định ban đầu khi nó được thành lập) mở"), nhưng chỉ thể hiện quy mô khái niệm cốt lõi.

OpenAI lần đầu tiên đề xuất bí quyết đào tạo mô hình trong Luật mở rộng quy mô năm 2020. Theo Scaling Law, hiệu năng của mô hình sẽ tiếp tục được cải thiện giống như Định luật Moore dựa trên sức mạnh tính toán lớn, tham số lớn và dữ liệu lớn, không chỉ áp dụng được cho các mô hình ngôn ngữ mà còn áp dụng cho các mô hình đa phương thức.

OpenAI đã đi theo tập hợp "thẩm mỹ bạo lực" này để khám phá khả năng nổi bật của các mô hình ngôn ngữ lớn và cuối cùng đã phát triển ChatGPT mang tính kỷ nguyên.

Điều tương tự cũng xảy ra với mô hình Sora, cùng với Scaling Law, đã đạt được "Khoảnh khắc giữa cuộc hành trình" của video vào tháng 2 năm 2024 mà không báo trước.

OpenAI tuyên bố rằng Transformer đã thể hiện các đặc tính mở rộng tuyệt vời trong nhiều lĩnh vực khác nhau, bao gồm mô hình hóa ngôn ngữ, thị giác máy tính, tạo hình ảnh và tạo video. Hình dưới đây cho thấy trong quá trình huấn luyện, với cùng một mẫu, khi thang tính toán huấn luyện tăng lên thì chất lượng video được cải thiện đáng kể.

OpenAI nhận thấy rằng các mô hình video thể hiện nhiều khả năng mới nổi thú vị khi được đào tạo trên quy mô lớn, cho phép Sora mô phỏng các khía cạnh nhất định của con người, động vật và môi trường trong thế giới thực. Các thuộc tính này xuất hiện mà không có bất kỳ sai lệch quy nạp rõ ràng nào đối với 3D, các đối tượng, v.v. - hoàn toàn là một hiện tượng chia tỷ lệ mô hình.

Do đó, OpenAI đặt tên cho mô hình tạo video là "world Simulators" (mô phỏng thế giới), hay "world model" - có thể hiểu là Để máy móc học tương tự cách con người hiểu thế giới.

Nhà khoa học Jim Fan của NVIDIA nhận xét: "Nếu bạn nghĩ OpenAI Sora là một món đồ chơi sáng tạo như DALL·E...hãy nghĩ lại. Sora là một nhà vật lý dựa trên dữ liệu công cụ. Nó là sự mô phỏng của nhiều thế giới, cả thực tế và tưởng tượng. Trình mô phỏng học cách kết xuất phức tạp, vật lý 'trực quan', lý luận và ngữ nghĩa dài hạn cùng với một số kiến thức cơ bản về toán học khử nhiễu và độ dốc."

Nhà khoa học trưởng của Meta, Yann LeCun đã đề xuất khái niệm mô hình thế giới vào tháng 6 năm 2023. Vào tháng 12 năm 2023, Runway chính thức công bố mô hình thế giới phổ quát của mình, tuyên bố rằng họ sẽ sử dụng AI tổng quát để mô phỏng toàn bộ thế giới.

OpenAI chỉ cung cấp cho Sora khả năng mô hình hóa thế giới thông qua Luật Tỷ lệ mà nó đã quen thuộc từ lâu. OpenAI cho biết: "Kết quả của chúng tôi cho thấy rằng việc mở rộng các mô hình tạo video là một lộ trình đầy hứa hẹn để xây dựng các trình mô phỏng chung về thế giới thực."

Cụ thể, mô hình thế giới Sora có ba đặc điểm:

Tính nhất quán 3D. Sora có thể tạo video bằng chuyển động của camera động. Khi máy ảnh di chuyển và xoay, con người và các yếu tố của cảnh chuyển động đồng thời trong không gian ba chiều.

Từ xaMức độ liên quanvà sự kiên trì của đối tượng. Thách thức đáng kể đối với hệ thống tạo video là duy trì tính nhất quán về thời gian khi lấy mẫu các video dài. OpenAI nhận thấy Sora thường (mặc dù không phải lúc nào cũng) có hiệu quả trong việc mô hình hóa các phần phụ thuộc ngắn hạn và dài hạn. Ví dụ: mô hình có thể giữ lại người, động vật và đồ vật ngay cả khi chúng bị che khuất hoặc rời khỏi khung. Tương tự như vậy, nó có thể tạo ra nhiều cảnh quay của cùng một nhân vật trong một mẫu duy nhất và duy trì diện mạo của nó trong suốt video.

Tương tác với thế giới. Sora đôi khi có thể mô phỏng các hành động ảnh hưởng đến điều kiện thế giới theo những cách đơn giản. Ví dụ, một họa sĩ có thể để lại những nét vẽ mới trên canvas và tồn tại theo thời gian.

Tương tự thế giới kỹ thuật số. Sora cũng có khả năng mô phỏng các quy trình thủ công - một ví dụ là trò chơi điện tử. Sora có thể đồng thời điều khiển người chơi trong Minecraft thông qua các chiến lược cơ bản đồng thời thể hiện thế giới và động lực của nó với độ trung thực cao. Những khả năng này có thể bị loại bỏ bằng cách nhắc Sora một tiêu đề đề cập đến Minecraft.

Tuy nhiên, giống như tất cả các người mẫu cỡ lớn, Sora vẫn chưa phải là một người mẫu hoàn hảo. OpenAI thừa nhận rằng Sora có nhiều hạn chế và nó không thể mô phỏng chính xác nhiều quá trình vật lý tương tác cơ bản, chẳng hạn như vỡ kính. Các tương tác khác (chẳng hạn như ăn thức ăn) không phải lúc nào cũng tạo ra sự thay đổi chính xác về trạng thái của vật thể.

3. Sức mạnh tính toán có phải là năng lực cạnh tranh cốt lõi không?

Tại sao OpenAI có thể dựa vào "Luật mở rộng quy mô" để thành công nhiều lần, mà các công ty khác không có?

Chúng ta có thể tìm thấy nhiều lý do, chẳng hạn như niềm tin vào AGI, sự kiên trì với công nghệ, v.v. Nhưng một yếu tố thực tế là Luật mở rộng yêu cầu chi phí năng lượng tính toán cao để hỗ trợ, đó là điều mà OpenAI giỏi.

Theo cách này, điểm cạnh tranh của các mô hình video có phần giống với các mô hình ngôn ngữ. Đầu tiên là khả năng điều chỉnh tham số kỹ thuật của nhóm và cuối cùng là khả năng tính toán quyền lực. .

Trong phân tích cuối cùng, đây rõ ràng là một cơ hội khác cho Nvidia. Được thúc đẩy bởi cơn sốt AI này, giá trị thị trường của NVIDIA đã tăng lên đều đặn, vượt qua Amazon và Google chỉ trong một cú trượt dốc.

Việc đào tạo các mô hình video sẽ tiêu tốn nhiều sức mạnh tính toán hơn các mô hình ngôn ngữ. Với sự thiếu hụt sức mạnh tính toán toàn cầu, OpenAI giải quyết vấn đề sức mạnh tính toán như thế nào? Nếu kết hợp với những tin đồn về việc xây dựng cốt lõi trước đây về OpenAI, mọi thứ dường như đã đâu vào đấy.

Kể từ năm ngoái, Giám đốc điều hành OpenAI Sam Altman (Sam Altman) đã huy động được 8 tỷ đến 100 triệu cho dự án sản xuất chip có tên mã "Tigris". Với Được tài trợ 100 triệu USD, họ hy vọng sẽ sản xuất được chip AI tương tự như TPU của Google, có thể cạnh tranh với Nvidia để giúp OpenAI giảm chi phí vận hành và dịch vụ.

Vào tháng 1 năm 2024, Altman cũng đã đến thăm Hàn Quốc và gặp gỡ các giám đốc điều hành của Samsung Electronics và SK Hynix của Hàn Quốc để tìm kiếm sự hợp tác trong lĩnh vực chip.

Gần đây, theo truyền thông nước ngoài đưa tin, Altman đang xúc tiến một dự án nhằm nâng cao năng lực sản xuất chip toàn cầu và đang làm việc với chính phủ Các Tiểu vương quốc Ả Rập Thống nhất, bao gồm cả việc Đàm phán với nhà đầu tư khác nhau. Số tiền huy động được từ kế hoạch này đã lên tới mức quá cao từ 5 nghìn tỷ USD đến 7 nghìn tỷ USD.

Người phát ngôn của OpenAI cho biết: "OpenAI đã có những cuộc thảo luận hiệu quả về việc tăng cường cơ sở hạ tầng và chuỗi cung ứng toàn cầu cho các con chip, năng lượng và trung tâm dữ liệu quan trọng đối với trí tuệ nhân tạo. và các ngành liên quan đều rất quan trọng. Do tầm quan trọng của các ưu tiên quốc gia, chúng tôi sẽ tiếp tục thông báo ngắn gọn cho chính phủ Hoa Kỳ và mong được chia sẻ thêm thông tin chi tiết vào một ngày sau đó."

Người sáng lập và Giám đốc điều hành NVIDIA Jensen Huang trả lời hơi mỉa mai: "Nếu bạn nghĩ máy tính không thể phát triển nhanh hơn, bạn có thể đi đến kết luận rằng chúng ta cần 14 hành tinh, 3 thiên hà và 4 mặt trời để làm điều đó. Tất cả những điều này cung cấp nhiên liệu. Tuy nhiên , kiến trúc máy tính thực sự không ngừng được cải thiện."

Đó là sự phát triển của các mô hình lớn nhanh hơn hay việc giảm chi phí điện năng tính toán? Nhanh hơn? Liệu nó có phải là người chiến thắng trong cuộc chiến 100 mẫu?

Năm 2024, câu trả lời sẽ dần được hé lộ.

JinseFinance

JinseFinance

JinseFinance

JinseFinance JinseFinance

JinseFinance JinseFinance

JinseFinance Anais

Anais Cheng Yuan

Cheng Yuan JinseFinance

JinseFinance JinseFinance

JinseFinance JinseFinance

JinseFinance Hui Xin

Hui Xin JinseFinance

JinseFinance